IMAGEN DE ALTA RESOLUCIÓN DEL FONDO DE OJO POR ...

Transcript of IMAGEN DE ALTA RESOLUCIÓN DEL FONDO DE OJO POR ...

IMAGEN DE ALTA RESOLUCIÓN DEL

FONDO DE OJO POR DECONVOLUCIÓN

TRAS COMPENSACIÓN PARCIAL

TESIS DOCTORAL

Justo Arines Piferrer

Departamento de Física Aplicada, Área de Óptica

Universidade de Santiago de Compostela

D Salvador X. Bará Viñas, profesor titular de universidade do Departamento de Física Aplicada (Área de Óptica) da Universidade de Santiago de Compostela, Fai constar Que a presente memoria, titulada "Imagen de alta resolución del fondo de ojo por deconvolución tras compensación parcial" recolle os resultados do traballo realizado por D. Justo Arines Piferrer baixo a súa dirección e supervisión, e constitúe a Tese de Doutoramento que presenta para a obtención do título de Doutor pola Universidade de Santiago de Compostela.

En Santiago de Compostela, a 17 de Abril de 2006

Asdo.: O director da Tese, Asdo.: O Doutorando,

D. Salvador X. Bará Viñas D. Justo Arines Piferrer

Una parte sustancial de los trabajos de investigación recogidos en esta memoria ha sido realizada en el marco de los proyectos de investigación DPI2002-04370-C02-01, "DESARROLLO DE COMPONENTES Y SISTEMAS PARA LA MEDIDA Y CORRECCIÓN DE ABERRACIONES ÓPTICAS EN EL OJO HUMANO" y FIS2005-05020-C03-02, “NUEVOS ESTUDIOS Y DESARROLLOS PARA LA MEDIDA Y COMPENSACIÓN DE ABERRACIONES OCULARES Y DE LA PRESBICIA” financiados por el Ministerio de Ciencia y Tecnología, el Ministerio de Educación y Ciencia y el FEDER.

a Yolanda,

Dios proveerá a los hombres de buena voluntad

Declaración de originalidad

Resumen La detección precoz de patologías que afectan al polo posterior ocular es de gran relevancia para su temprano diagnóstico. En este ámbito hemos desarrollado una cámara de fondo de ojo que incorpora un sensor de frente de onda tipo Hartmann-Shack con el fin de emplear la técnica de deconvolución tras medida de frente de onda con compensación parcial para la obtención de imágenes de alta resolución espacial de la retina humana en vivo. Gran parte del trabajo desarrollado se centra en el estudio del Hartmann-Shack. Así hemos analizado la influencia del procesado por umbralización en la incertidumbre asociada a la determinación del centroide de los spots correspondientes a las microlentes del sensor. También hemos estudiado la influencia del umbral en la estimación del gradiente local de la fase, observando la perdida de linealidad en la relación entre el centroide del spot y el gradiente de la fase. Igualmente hemos estudiado la importancia del correcto modelado tanto de las medidas como del frente incidente a la hora de realizar la estimación de los coeficientes modales. También hemos estudiado la relación existente entre los coeficientes estimados respecto a dos sistema de coordenadas relacionados por una transformación lineal de coordenadas con el fin de desacoplar del proceso de estimación modal los movimientos oculares ocurridos durante el proceso de medida. Finalmente hemos analizado como se propagan los errores de modelado y de las medidas del gradiente a la estimación de la función de transferencia óptica. Desde un punto de vista del desarrollo del dispositivo hemos incluido el empleo de elementos ópticos que inducen aberraciones de alto orden en el proceso de calibrado del sensor de frente de ondas tipo Hartmann-Shack, comprobando la importancia de esta etapa en dicho calibrado. En cuanto al proceso de deconvolución se ha mostrado la posibilidad de emplear la técnica de deconvolución tras medida del frente de onda y compensación parcial para la obtención de imágenes de alta resolución del fondo ocular tanto mediante simulación como experimentalmente con ojos artificiales y ojos reales. Más aún se ha evaluado la posibilidad de emplear esta técnica en tiempo real debido al aumento de la relación señal ruido producida por el empleo de la lámina compensadora de fase.

Publicaciones relacionadas con esta tesis

Publicaciones relacionadas con esta tesis Artículos J Arines, S. Bará, “Significance of the recovery filter in deconvolution from

wavefront sensing:”, Opt. Eng, 39(10), 2789-2796, 2000. J.Ares, J. Arines, “Effective noise in thresholded intensity distribution: influence

on centroid statistics”, Opt. Lett, 26(23), 1831-1833, 2001. J.Arines, J. Ares, “Minimum variance centroid thresholding”, Opt. Lett, 27(7),

497-499, 2002. J.Arines, S.Bará, “Hybrid technique for high resolution imaging of the eye

fundus”, Opt. Exp., 11 (7), 761-766, 2003. J.Arines, J. Ares, “Significance of thresholding processing in centroid based

gradient wavefront sensors: effective modulation of the wavefront derivative”, Opt. Comm. 237, 257-266, 2004.

J. Ares, J. Arines, “Influence of thresholding on centroid statistics, a full analytical description”, Appl. Opt. 43(31), 5796-5805, 2004.

P. Rodríguez, Navarro R., J. Arines, S. Bará, “A new calibration set of phase plates for ocular aberrometers”, J.Ref.Surg, 22(3), 275-284, 2006

S. Bará, J. Arines, J. Ares, P. Prado, “Direct transformation of Zernike eye aberration coefficients between scaled, rotated and/or displaced pupils”, enviado a J.Opt.Soc.Am. A, Aceptado.

L. Diaz-Santana, J. Arines, P. Prado, S. Bará, “Translational and rotational pupil tracking using wavefront aberration data and image registration techniques”, Opt. Lett. Aceptado.

Patentes R. Navarro, P. Rodríguez, J. Arines, S. Bará, “Conjunto de láminas de fase para calibración de aberrómetros y realización de modelos ópticos y oculares”, P200401397, 09/06/2004. Otras publicaciones S. Bará, J. Arines, J. Ares, P. Prado, “Fotoescultura: tecnología microóptica para

la Optometría del siglo XXI”, Ver y Oir, Noviembre 2005.

Agradecimientos

Agradecimientos Para empezar tengo la obligación institucional y moral de comenzar los agradecimientos por mi feje, D. Salvador X. Bará Viñas ya que sin su firma personal este trabajo no podría elevarme al grado de Doctor. Pero también tengo que agradecerle los debates y correcciones que han servido para concluir este trabajo y desarrollar una patología obsesiva sobre la semántica del lenguaje. Otra mención al segundo de abordo D. Jorge Ares por todos los ratos que hemos pasado juntos (y han sido muuuuuuchos) que han servido para llegar hasta aquí. Reconocer también la comunicación con todos aquellos que han pasado por los despachos de arriba y de abajo en estos 8 años. Por acortar la lista (de la que quiero destacar a Maite por su amistad dentro y fuera del despacho) la resumiré en un JASP = Jóvenes Aunque Sobradamente Preparados. Felizmente casado tengo que agradecerle a Yolanda (en relación a mi dedicación al desarrollo tecnológico y científico de mi país) todos los esfuerzos y renuncias realizadas a lo largo de estos años. Igualmente siguiendo la línea empezada con la redacción de mi tesina, tengo que agradecer a todos los amigos que comenzaron preguntando ¿Cuándo presentas la tesina? y luego pasaron a preguntarme ¿Cuándo presentas la tesis? a lo que yo de nuevo respondía con cara circunspecta: PRONTO!!!! No puedo olvidarme de ningún modo de los miembros de mi primera unidad familiar. Así que muchas gracias. En cuanto a agradecimientos en el ámbito científico quiero hacer una mención especial de nuevo a mi feje, D. Salvador, por proporcionar dos elementos fundamentales en la realización de la parte experimental de esta tesis: la matriz de microlentes del sensor, y las láminas de fase necesarias para la realización de las experiencias relacionadas con la aplicación de la técnica de deconvolución tras compensación parcial.

Agradecimientos

Por otra parte quiero también agradecer a Paula su gran ayuda tanto en la obtención de las medidas temporales de la aberración ocular como en la obtención de las imágenes de fondo de ojo. También quisiera agradecer a las distintas entidades que han financiado de alguna manera la realización de este trabajo, la Universidade de Santiago de Compostela y el CIXTEC. Finalmente también agradecer a David Williams, investigador del Center for Visual Science de la Universidad de Rochester, el consentimiento necesario para el empleo de la imagen de conos obtenida en su laboratorio con óptica adaptativa en la realización de las simulaciones del proceso de deconvolución tras compensación parcial.

Índice

Índice Capítulo 1:Introducción 1 1.1 Factores que limitan la calidad de las imágenes y efecto sobre el estudio de la retina in vivo. 2 1.2 Técnicas de observación del polo posterior ocular 3 1.2.1 Oftalmoscopio de barrido láser 4 1.2.2 Tomografía de coherencia óptica 5 1.2.3 Imagen Polarimétrica 6 1.2.4 Óptica Adaptativa 6 1.2.5 Deconvolución de frente de onda 8 1.3 Objetivo y Sinopsis del Trabajo 10 Capítulo 2: Estructuras oculares de interés óptico 13 2.1 La lágrima 14 2.2 La córnea 15 2.3 Humor acuoso 15 2.4 El iris 15 2.5 El cristalino 15 2.6 Humor vítreo 16 2.7 La retina 16 2.8 La coroides 18 2.9 La esclerótica 18 2.10 Transmisión, Absorción, Reflexión, Polarización y Dispersión 18 2.11 Efecto Stiles-Crawford 21

Índice

Capítulo 3:Medida de aberraciones oculares 23 3.1 Representación de la aberración de onda 25 3.1.1 Polinomios de Zernike 25 3.2 Aberraciones oculares 27 3.2.1 Fuentes de aberraciones oculares 27

3.2.1.2 Estadística Poblacional y Temporal 28 3.2.1.2.1 Estadística Poblacional 28

3.2.1.2.2 Estadística Temporal 29 3.3 Medida de Aberraciones oculares 33 3.3.1 Evolución histórica 33 3.3.2 Sensores de Gradiente 35 3.3.2.1 Descripción Teórica 35 3.3.2.2 Estimadores lineales 46 3.3.2.3 Fuentes de Ruido en la estimación de la aberración 49 3.3.2.3.1 Errores en la determinación del gradiente 49 3.3.2.3.1.1 Errores sistemáticos 50 3.3.2.3.1.2 Errores aleatorios 51 3.3.2.3.1.2.1 Valor medio del centroide 54 3.3.2.3.1.2.2 Varianza del centroide 57 3.3.2.3.1.2.3 Validación de las expresiones 59 3.3.2.3.1.2.3.1 Validación mediante simulación 59 3.3.2.3.1.2.3.2 Validación experimental 63 3.3.2.3.1.2.4 Minimización de la varianza del centroide 67

3.3.2.3.2 Errores en la estimación de los coeficientes modales 68 3.3.2.4 Representación del frente en sistema Lab/Pupila Ojo 72

3.3.3 Influencia del error del sensor en la estimación de la OTF ocular 85 Capítulo 4:Aberraciones ópticas y calidad de imagen 93 4.1 Influencia de las aberraciones en la calidad de la imagen 94 4.2 Compensación óptica de aberraciones oculares 96 4.2.1 Láminas de fase 97 4.2.2 Espejos deformables 98 4.2.3 Pantallas de cristal líquido 98 4.3 Resolución, Relación Señal-Ruido y necesidad de compensación Parcial 99

Índice

Capítulo 5: Técnica de deconvolución 105 5.1 Deconvolución de imágenes 106 5.1.1 Obtención del filtro de restauración 107 5.1.1.1 Filtro de Wiener 109 5.1.1.2 Filtro Regresivo 111 5.1.1.3 Filtro vectorial de Wiener 112 5.2 Importancia de la elección del filtro de restauración 113 5.3 Deconvolución basada en medida del frente de onda con compensación parcial: DWFS-PC 117 5.3.1 Canal de imagen 118 5.3.2 Canal del sensor 118 5.3.3 Cómputo de la OTF 119 5.3.4 Filtro restaurador 121 Capítulo 6:Deconvolución de imágenes de fondo de ojo(I): análisis de viabilidad 123 6.1 Descripción del simulador 124 6.1.1 Algoritmo de la simulación 130 6.2 Parámetros de evaluación 132 6.3 Resultados de la Simulación 134 6.3.1 Primera simulación: Aberración estática 134 6.3.2 Segunda simulación: Aberración dinámica 139

Índice

Capítulo 7: Deconvolución de imágenes de fondo de ojo (II): resultados experimentales 153 7.1 Descripción del sistema 154 7.1.1 Canal de iluminación 156 7.1.1.1 Fuente 1 157 7.1.1.2 Fuente 2 158 7.1.2 Segmento intermedio 159 7.1.3 Canal de la imagen 160 7.1.4 Canal del sensor 161 7.1.4.1 Monitorización de la pupila 161 7.1.4.2 Parámetros del sensor 162 7.1.4.3 Criterios de selección 162 7.1.4.4 Procesado de imágenes del sensor 164

7.1.4.4.1 Cálculo de los coeficientes estimados 169 7.1.4.5 Seguimiento pupilar 171 7.2 Fabricación de láminas de fase 174 7.3 Calibración del Sensor 176 7.3.1 Calibración con onda esférica 177 7.3.2 Calibración con pantallas de fase 179 7.4 Resultados de la deconvolución en Ojo Artificial 181 7.4.1 Descripción de la experiencia 181 7.4.2 Resultados 183 7.5 Resultados de la Deconvolución en ojos reales 186 7.5.1 Descripción de la experiencia 187 7.5.2 Resultados de la compensación parcial 188 7.5.3 Resultados de la DWFS-PC 192 Capítulo 8: Conclusiones 203 Apéndice A 207 Apéndice B: Primeras páginas de los artículos relacionados con esta tesis 209 Declaración de Originalidad 129 Referencias 223

CAPÍTULO 1 1

CAPÍTULO 1

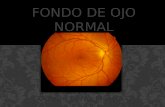

INTRODUCCIÓN La existencia de técnicas de exploración del globo ocular que permitan la detección de estructuras anatómicas de origen patológico en sus estadios iniciales, es de gran importancia para realizar un diagnóstico temprano que garantice un mayor éxito del tratamiento que se decida aplicar. Es por ello que es necesario desarrollar técnicas de observación que proporcionen imágenes de alta resolución espacial. En la observación del polo posterior ocular el elemento que limita la resolución espacial de las imágenes que se obtienen con las técnicas de exploración tradicionales (oftalmoscopios directos e indirectos y cámaras de fondo de ojo) es la propia óptica del ojo del sujeto, y la dispersión (“scattering”) producido en los medios oculares. Las técnicas tradicionales tienen incorporados sistemas para la compensación de las aberraciones oculares de primer (prisma) y segundo orden, es decir desenfoque y astigmatismo, pero el ojo humano también presenta aberraciones de mayor orden. La obtención de imágenes de alta resolución espacial del fondo de ojo ocular pasa por la compensación de estas aberraciones de alto orden y la reducción del “scattering” intraocular. A continuación vamos a profundizar un poco más en estos factores.

2 1.1 Factores que limitan la calidad de las imágenes ...

1.1 Factores que limitan la calidad de las imágenes y efecto sobre el estudio de la retina in vivo. La calidad de las imágenes del polo posterior ocular que se pueden obtener mediante los distintos instrumentos ópticos existentes está limitada principalmente por dos factores externos a dichos aparatos. Dichos factores son por un lado las aberraciones oculares y por el otro el scattering intraocular. Cuando hablamos de aberraciones oculares en este trabajo nos estamos refiriendo a las distorsiones del frente de onda (respecto a una onda de referencia) introducidas por el ojo del sujeto. Es bien conocido que dichas distorsiones del frente de onda conllevan la disminución de la función de transferencia óptica (OTF) [Goo68] provocando una reducción en la resolución espacial del sistema óptico y por consiguiente el emborronamiento de la imagen retiniana. La aberración ocular humana se puede dividir atendiendo a su comportamiento temporal en una componente estática y otra dinámica de menos magnitud. Mientras que si atendemos al grado del polinomio que la describe hablaremos de aberración de bajo o alto orden. Teniendo en cuenta esta clasificación podemos decir que la componente estática de bajo orden es de valor significativo para la calidad de vida del sujeto [Zhu04]. Su corrección es de gran importancia para la realización de tareas de la vida diaria, existiendo también ojos en los que la compensación de aberraciones de alto orden estáticas se hace igualmente indispensable. Por otra parte la componente dinámica es de menor magnitud, del orden de las 0.15 micras para pupilas de 4.7 mm de diámetro [Hof01], en valor rms (del inglés root-mean square ). La mayor contribución a esta fluctuación proviene de las microfluctuaciones de la acomodación, y de la dinámica lagrimal. Su valor es muy próximo al limite de aberración necesario para que el sistema sea considerado limitado por difracción según el criterio de Marechal [Zhu04, Bor92]. En este sentido esta componente carece de relevancia para la realización de tareas rutinarias por parte del ser humano, pero si que tiene su importancia en tareas de observación de estructuras oculares internas, siendo necesaria su corrección para la obtención de imágenes nítidas del fondo de ojo [Zhu04]. En capítulos sucesivos describiremos en más detalle las aberraciones oculares, tanto sus orígenes como su estadística temporal y poblacional, métodos de determinación, efectos sobre la OTF...

1.2 Técnicas de observación del polo posterior ocular 3

El otro factor que limita la calidad de las imágenes de fondo de ojo ocular es el “scattering” que se produce en los distintos medios intraoculares. Los principales medios oculares responsables del “scattering” son el cristalino y la retina. En el caso de un sujeto joven en el que el cristalino no presenta opacidades el scattering inducido es despreciable quedando como principal fuente la retina. Como veremos más adelante ésta está constituida por un conjunto de capas especializadas formadas por distintos tipos de células. Es en estas capas donde la presencia de distintas estructuras ocasiona el “scattering” de luz [Els92, Hod94, Els00]. El “scattering” intraocular provoca el ensanchamiento de la PSF del ojo y una disminución del contraste debida a presencia de luz difusa dispersada por las distintas estructuras oculares responsables del scattering [Hod94]. Como hemos indicado tanto las aberraciones como el “scattering” ocular son responsables de la disminución de la calidad óptica del ojo. A continuación vamos a presentar una serie de técnicas desarrolladas para reducir el efecto de estos dos elementos sobre la observación del fondo ocular. 1.2 Técnicas de observación del polo posterior ocular La observación con baja resolución del fondo ocular es una tarea sencilla que sólo necesita de un sistema de iluminación que nos permita introducir luz en el ojo, y un sistema de observación que nos proporcione una imagen ampliada de la retina. Este es el principio de funcionamiento del oftalmoscopio. Según sea el sistema de observación tendremos dos variantes, el oftalmoscopio directo que emplea la propia óptica del ojo del sujeto como lupa, proporcionando imágenes aumentadas y no invertidas de la retina y el oftalmoscopio indirecto, que sitúa una lente de gran potencia dióptrica entre el ojo del sujeto y el del observador proporcionando una imagen de la retina invertida y con mayor aumento que en el caso anterior. El empleo de tanto el oftalmoscopio directo como indirecto presenta una serie de limitaciones: falta de confort durante el proceso de observación tanto para el observador como para el sujeto; campo de observación relativamente pequeño; aumentos bajos que limitan el tamaño mínimo de las estructuras del fondo ocular que se pueden observar; y sobre todo la imposibilidad de registrar las imágenes del fondo de ojo (hecho importante a la hora de comprobar la evolución de cualquier patología). Con el fin de superar estas limitaciones se desarrollaron las cámaras de fondo de ojo. Éstas consisten en un oftalmoscopio indirecto que presenta un sistema que permite cambiar el campo angular de observación, los aumentos de la

4 1.2 Técnicas de observación del polo posterior ocular

imagen retiniana, corregir la ametropía del sujeto, y registrar las imágenes del fondo de ojo. Con posterioridad a las cámaras de fondo de ojo se desarrollaron: el Oftalmoscopio de barrido láser, la Tomografía de Coherencia Óptica, y la técnica de Imagen Polarimétrica (técnicas que presentaremos a continuación). Con estas técnicas se consiguió mejorar el contraste de las imágenes del fondo de ojo al reducir sobre todo la presencia de luz dispersada por las distintas estructuras oculares. También se consiguió la obtención de imágenes tridimensionales del fondo ocular. Sin embargo la resolución transversal de dichos sistemas era inferior a la que cabria esperar, como ya ocurría con las cámaras de fondo de ojo tradicionales debido a las aberraciones oculares. Con el fin de superar dicha limitación se introdujeron en el campo de la instrumentación oftálmica una serie de técnicas que permiten la corrección de dicha aberración como: la Óptica Adaptativa (AO), y la Deconvolución tras medida del frente de onda (DWFS). 1.2.1 Oftalmoscopio de barrido laser El oftalmoscopio de barrido láser (SLO) es un dispositivo que permite la obtención de imágenes del fondo de ojo mediante la proyección secuencial de un haz láser de baja potencia sobre distintas posiciones consecutivas de la retina [Dre89]. La luz reflejada correspondiente a cada una de las proyecciones es recogida mediante el sistema óptico de observación y registrada mediante un fotodiodo. Cada una de las proyecciones se corresponde con la información de intensidad de cada uno de los píxeles de la imagen resultante. Este procedimiento de observación presenta la ventaja de que aumenta el contraste de las imágenes respecto a las obtenidas mediante las cámaras de fondo de ojo convencionales. Posteriormente se comprobó la utilidad de situar justo delante del fotodetector (que se encuentra en un plano conjugado con la retina del sujeto) un agujero de radio reducido a modo de diafragma de campo. A este nuevo instrumento se le llamó oftalmoscopio de barrido láser confocal [Els92]. La ventaja fundamental de emplear este filtro es que se consigue aumentar el contraste de las imágenes y la resolución axial hasta aproximadamente las 300 μm, que es limite de resolución insuperable sin corregir las aberraciones ópticas de alto orden del ojo del sujeto. [Car05]. Este incremento de resolución se debe a que con el diafragma confocal conseguimos evitar que llegue al fotodetector tanto luz esparcida por las distintas capas de la retina que se encuentran próximas al plano de observación, como por

1.2 Técnicas de observación del polo posterior ocular 5

la luz reflejada en las distintas interfaces oculares como la córnea o el cristalino [Del89, Els92, Els00]. 1.2.2 Tomografía de coherencia óptica La tomografía de coherencia óptica (OCT) es una técnica de imagen que proporciona imágenes bi o tri-dimensionales creadas a partir de la combinación de trazas longitudinales unidimensionales [You87 Hua91, Fuj98, Fer02]. En OCT la estructura interna de la muestra es analizada mediante la proyección de un haz de luz sobre la muestra y midiendo el tiempo de retardo de la luz reflejada en las distintas estructuras internas que el haz de luz se encuentra en su camino. La parte central de un OCT es un interferómetro de baja coherencia óptica, normalmente en configuración tipo Michelson [Fer02]. En esta disposición la muestra que se quiere analizar es colocada en uno de los brazos del interferómetro, mientras que en el otro brazo (el brazo de referencia) se coloca un espejo móvil. La luz reflejada por la muestra y por el espejo móvil situado en el brazo de referencia son combinadas en el detector, que mide la intensidad producida por la interferencia de ambos haces. El análisis en profundidad de la muestra se realiza desplazando el espejo situado en el brazo de referencia de forma que la interferencia constructiva solo ocurre cuando la diferencia de camino óptico entre los dos brazos es menor que la longitud de coherencia óptica de la fuente de luz empleada en el OCT. La OCT presenta como principales ventajas: su gran poder de penetración [Rog01]; resolución longitudinal típica en el rango de las 3-10 micras [Ko04]; y posibilidad de operar en tiempo real [Dre99]. Debido a estas ventajas se ha hecho gran hincapié en su uso en aplicaciones medicas cuyo fin es el análisis de tejidos [Fuj86, Fuj98, Pod00], y como no el ojo [Hee95, Cha99, Zha05]. La resolución transversal del OCT viene determinada por la apertura numérica del sistema mientras que la resolución longitudinal viene determinada por la longitud de coherencia óptica. Así se ha conseguido pasar de resoluciones longitudinales típicas del orden de las 10 micras (conseguidas con el empleo de diodos superluminiscentes (SLD)) a resoluciones de 1-2 micras con el empleo de diodos orgánicos o láseres de Ti:Al2O3 [Ko04, Her04].

6 1.2 Técnicas de observación del polo posterior ocular

El empleo de la OCT en la observación de estructuras oculares se ha demostrado como una técnica de gran importancia en el diagnóstico de patologías como la retinopatía diabética, edema macular, neovascularización subretiniana y patologías del nervio óptico [Rog01]. 1.2.3 Imagen polarimétrica Es bien conocido que el ojo humano presenta ciertas propiedades respecto a su interacción con la luz polarizada. La caracterización de estas propiedades se realiza mediante el análisis de Müller [Bue02, Bue03]. Del aprovechamiento del efecto que produce el ojo sobre el estado de polarización de la luz incidente surge la técnica de Imagen Polarimétrica. La luz que incide sobre la retina sufre una fuerte reflexión en la primera capa retiniana mientras que la luz que penetra en las siguientes capas sufre esparcimiento múltiple. Durante el proceso de esparcimiento la luz que se refleja hacia atrás sufre una despolarización, mientras que la luz fuertemente reflejada en la primera capa mantiene el grado de polarización inicial. Aprovechando este comportamiento podemos mejorar las imágenes retinianas al aumentar su contraste sin más que restar la imagen obtenida con luz despolarizada de la obtenida con luz polarizada [Bur03, Kni02]. En las páginas anteriores hemos descrito brevemente distintas técnicas que se han ido desarrollando con el fin de obtener imágenes retinianas de mayor resolución espacial (tanto longitudinal como transversal). Sin embargo dicho aumento en la resolución no se debe a una mejora de la respuesta de impulso de la óptica del sistema (PSF) sino a una reducción de la contribución de la luz esparcida o directamente reflejada por la retina. En los siguientes párrafos presentaremos una serie de técnicas de imagen que si fueron desarrolladas para mejorar la respuesta de impulso del sistema óptico de observación. Cabe decir que estas técnicas han sido incorporadas con éxito a los dispositivos de observación presentados anteriormente, aumentando significativamente su resolución [Her04, Roo00]. 1.2.4 Óptica Adaptativa Los sistemas de Óptica Adaptativa (OA) son sistemas que tratan de compensar la distorsión del frente de onda induciendo retardos/ganancias en el camino óptico de las distintas partes del frente con el fin de que a la salida del sistema se tenga el frente de onda deseado [Tys91, Bec93]. La idea de compensar la distorsión de la

1.2 Técnicas de observación del polo posterior ocular 7

fase usando servo sistemas surgió de la mente de H.W. Babcock, el cual en 1953 publicó el articulo titulado “The possibility of compensating astronomical seeing” [Bab53] donde presenta dicha idea. Inicialmente esta tecnología fue pensada para su utilización en el campo militar y posteriormente en astronomía, con el fin de compensar los efectos de la turbulencia atmosférica sobre las imágenes obtenidas mediante telescopios terrestres. En 1989 Dreher et.al. implementaron el primer sistema de Óptica Adaptativa con fines oftalmológicos, al desarrollar el primer oftalmoscopio de barrido láser con Óptica Adaptativa [Dre89]. El sistema adaptativo implementado solo permitía la corrección dinámica de la componente de desenfoque y astigmatismo. En 1961 Smirnov propuso la corrección de las aberraciones de alto orden con el fin de mejorar el sistema óptico humano [Smi61], pero no fue hasta 1997 cuando Liang et.al mediante un sistema de OA realizaron la primera compensación de las aberraciones de alto orden del ojo humano [Lia97]. Este retraso se debió fundamentalmente a la falta de una tecnología que permitiera compensar suficientemente bien las aberraciones oculares. Cabe mencionar que el dispositivo basado en un espejo deformable empleado por Liang et. al. a pesar de ser un sistema de OA se empleo para realizar compensaciones estáticas de la aberración. Este tipo de compensación también fue realizada empleando láminas de fase por R. Navarro et. al. en el 2000 [Nav00]. No fue hasta 2001 cuando una serie de grupos realizaron las primeras medidas y correcciones dinámicas de la aberración ocular [Fer01, Hof01, Lar01]. Un sistema de OA presenta dos elementos imprescindibles, el sensor de frente de onda y el elemento óptico dinámico que induce cambios en la diferencia de camino óptico entre las distintas partes del frente. En la OA oftálmica la batalla en cuanto a los sensores de frente de onda la gano el sensor tipo Hartmann-Shack [Car05], que describiremos mas adelante en el capítulo 3. En cuanto al elemento dinámico el más utilizado actualmente es el espejo deformable [Car05]. El espejo deformable consiste en una membrana reflectante flexible que se controla mediante una serie de actuadores situados en su parte posterior, deformando el espejo de la forma deseada. El sistema de OA primero determina, mediante el sensor de frente de onda, el retardo entre las distintas partes del frente y dicha información es empleada para deformar el espejo con el fin de compensar dicho retardo. Este proceso se realiza de

8 1.2 Técnicas de observación del polo posterior ocular

forma dinámica prácticamente en tiempo real. Gracias al empleo de la OA se consigue reducir la aberración del frente de onda hasta las 0.1-0.15 micras rms lo que permite obtener imágenes de mayor resolución espacial y mejor relación señal ruido [Fer01, Hof01, Lar01, Hof01B, Gla04]. Estos dos factores hacen de la OA una técnica muy apetecible para su uso como parte de instrumentos oftálmicos que ya son de por si de alta resolución como el SLO y la OCT [Roo02, Her04, Car05], con lo que se consigue mejorar aún más el poder de resolución de dichos instrumentos. Pero la técnica de la OA presenta una serie de desventajas, siendo las principales de ellas: el limitado rango de compensación de aberraciones debido al pequeño rango dinámico del elemento corrector ( apenas 8-6 micras [Roo00], [Gla04]); difícil implementación y mantenimiento; elevado coste del montaje; no es portátil, necesitando grandes espacios para su montaje [Roo00, Car05]. 1.2.5 Deconvolución de frente de onda Igual que la OA la Deconvolución de Frente onda (DFWS del inglés “Deconvolution from Wavefront Sensing”) es una técnica cuyo fin es corregir los efectos que el frente de onda aberrado existente sobre la pupila de salida del sistema óptico induce sobre las imágenes producidas por el sistema. Dicha corrección se realiza posteriormente a la detección de la imagen a partir de la información proporcionada por un sensor de frente de onda. El desarrollo de esta técnica data de 1990 [Pri90], donde se aplicó a la corrección de imágenes degradadas por la turbulencia atmosférica. Este primer trabajo se realizó en el laboratorio, aunque en ese mismo año dicha técnica fue empleada con éxito en la restauración de imágenes astronómicas [Gon90]. Así pues igual que la OA es una técnica originaria de la astronomía. Se desarrolló ya en su origen como una alternativa a la OA barata y de fácil implementación. Sin embargo así como en el campo de la astronomía la obtención de imágenes de alta resolución no tiene por que llevarse a cabo en tiempo real, en el campo de la oftalmología si que es una cuestión a tener en cuenta. En este sentido la incapacidad inicial de obtener imágenes de alta resolución en tiempo real supone una de las grandes desventajas respecto a la OA. Otra desventaja es la baja relación señal ruido (SNR) de las imágenes del fondo de ojo ocular, lo que limita en exceso la aberración óptica ocular que se puede corregir con esta técnica [Ari03].

1.2 Técnicas de observación del polo posterior ocular 9

En el campo de la óptica oftálmica se ha tratado relativamente poco la aplicación de la técnica de DWFS. El primer intento para obtener imágenes de alta resolución del fondo de ojo se llevó a cabo en el año 2000 por dos grupos de investigación distintos [Ari00, Igl00]. En el trabajo de Arines-Bará se mostró mediante simulación la posibilidad de obtener imágenes de alta resolución mediante DFWS tras compensación parcial de la aberración con un elemento óptico de fase. A dicha técnica le llamaron DWFS-PC. Por otra parte y casi simultáneamente el grupo de Iglesias-Artal muestra igualmente la utilidad de la DWFS mediante simulación. Sin embargo en su intento de implementar la técnica experimentalmente con ojos reales no consiguieron obtener mejora significativa de las imágenes del fondo ocular [Igl00]. En el 2002 Catlin-Dainty [Cat02] consiguieron obtener las primeras imágenes de los conos de la retina mediante DWFS. Además apuntaron la imposibilidad de obtener imágenes de alta resolución en tiempo real mediante DWFS debido a que la baja SNR les obligó a promediar un mínimo de 20 imágenes para poder obtener resultados positivos. Un año después en nuestro grupo comprobamos mediante simulación la posibilidad de obtener imágenes de alta resolución en tiempo real mediante una técnica de DWFS-PC [Ari03]. En dicho trabajo se muestra que la posibilidad de emplear la DFWS-PC en tiempo real se debe al gran incremento de la SNR de la imagen y del sensor al corregir la mayor parte de la aberración óptica del sujeto con un elemento compensador de fase estático. Relacionada con la DWFS existen otras técnicas de restauración de imagen que no necesitan información del frente de onda. Entre ellas destacamos la Deconvolución Ciega (BD, en ingles “Blind Deconvolution”) por ser la más usada en el campo de la oftalmología [Aye88, Chi04, Yan04]. Esta técnica obtiene información de la aberración y de la imagen sin degradar a partir de la imagen degradada y de una serie de ligaduras como: linealidad e invariabilidad del sistema, y positividad de la imagen y de la PSF entre otras. Con la aplicación de esta técnica se ha conseguido por ejemplo reducir el error en la clasificación de los conos de retinas humanas [Chi04], y mejorar imágenes de fondo de ojo [Yan04]. En ambos casos la BD se empleo sobre imágenes de fondo de ojo obtenidas mediante OA.

10 1.3 Objetivo y Sinopsis del trabajo

1.3 Objetivo y Sinopsis del Trabajo El objetivo principal de este trabajo es el desarrollo de una nueva técnica de alta resolución espacial para la observación del polo posterior ocular. Dicha técnica consiste en una modificación de la tradicional cámara de fondo de ojo que incluye la utilización de un elemento óptico estático personalizado en el canal de observación que compensa gran parte de la aberración ocular del sujeto, y un sensor de frente de onda que determina la aberración de onda residual, con el propósito de realizar una compensación posterior de la imagen de fondo de ojo mediante la técnica de deconvolución tras medida del frente de onda con compensación parcial (DWFS-PC). La técnica desarrollada proporciona imágenes del polo posterior ocular de mayor resolución espacial, lo que nos permitirá detectar estructuras anatómicas más pequeñas que no podrían ser observadas mediante las técnicas de exploración tradicionales. La tesis se estructura de la siguiente forma: El capitulo dos constituye una descripción de las estructuras oculares de interés óptico. Dicha descripción se realizo sobre todo atendiendo a sus propiedades ópticas: índice de refracción, absorción, dispersión... El capitulo tres se centra en las aberraciones oculares y su medida. Empezaremos este capitulo presentando el concepto de aberración de onda y la forma que emplearemos para describirla. Seguidamente analizaremos su origen y sus propiedades estadísticas tanto poblacionales como temporales. Posteriormente realizaremos una breve descripción histórica de los distintos instrumentos empleados para analizar la aberración ocular. A continuación realizaremos un análisis pormenorizado del sensor de frente de onda tipo Hartmann-Shack. Empezaremos con su descripción teórica, en la que incluiremos el preprocesado por umbralización. Después describiremos el proceso de estimación lineal de los coeficientes modales de la expansión de la aberración en serie de polinomios de Zernike. Seguidamente analizaremos las distintas fuentes de error que afectan al sensor: errores en la medida del gradiente local de la fase, y errores de estimación. Posteriormente presentaremos la importancia de la elección del sistema de referencia a la hora de analizar la aberración ocular. Finalmente mostraremos el efecto sobre la función de transferencia óptica estimada de los errores presentes en el proceso de estimación de los coeficientes modales.

1.3 Objetivo y Sinopsis del trabajo 11

En el capitulo cuatro analizaremos la relación entre las aberraciones oculares y la calidad de la imagen. Describiremos las distintas técnicas ópticas existentes para compensar la aberración ocular: espejos deformables, pantallas de cristal líquido, laminas de fase. Finalmente mostraremos la importancia de la compensación óptica de la aberración ocular en relación con el aumento de la frecuencia de corte efectiva del sistema. En el capitulo cinco nos centraremos en la técnica de deconvolución. Empezaremos realizando una descripción general de dicha técnica. Seguidamente analizaremos los principales filtros de restauración empleados. Finalmente describiremos en detalle la técnica de DWFS-PC. El capitulo seis muestra el análisis de viabilidad de la técnica que desarrollamos. Primero describiremos la simulación que realizamos para comprobar su viabilidad. Posteriormente presentamos los resultados de dicha simulación. En el capitulo siete describiremos el sistema implementado y los resultados obtenidos con él. Empezaremos realizando una profunda descripción del montaje, haciendo especial hincapié en el sensor de frente de onda. Analizaremos la calibración del sensor. Presentaremos el proceso de fabricación del elemento compensador de fase empleado. Mostraremos los resultados experimentales obtenidos con nuestro sistema. Y finalmente realizaremos el análisis y valoración de los resultados, presentando las limitaciones del sistema actual y las mejoras que se puedan aplicar. El capitulo ocho tratará las conclusiones del trabajo. En el apéndice presentaremos todos aquellos desarrollos matemáticos y comentarios que no son fundamentales para el seguimiento del discurso pero que son interesantes en el cómputo global del trabajo.

CAPITULO 2 13

CAPÍTULO 2

ESTRUCTURAS OCULARES DE INTERÉS ÓPTICO

En este capitulo vamos a realizar una breve descripción de la anatomía del ojo, centrándonos fundamentalmente en aquellas características que mayor relevancia presentan desde el punto de vista de su interacción con la luz. Empezaremos describiendo la lágrima, posteriormente la cornea y así sucesivamente hasta llegar a la retina. Las principales referencias de carácter general que empleamos en este capítulo referentes a cuestiones de la histología del globo ocular son las siguientes: [Ros97, You00, Mor00, Roo02B].

2.1 La lágrima 14

2.1 La lágrima La película lagrimal constituye el primer elemento óptico del sistema visual humano. Su integridad es fundamental para garantizar la salud de la cornea y conjuntiva, y asegurar una buena calidad óptica de la córnea. Su índice de refracción medio es de 1.337 y su espesor medio es aproximadamente de 3-1.5 μm [Wan03, Kin03]. Consta de tres capas diferenciadas: la capa lipídica de 50 nm de espesor es producida por las glándulas de Meibomio. Su función más importante es retrasar la evaporación de la película lagrimal además de proporcionar una superficie de gran calidad óptica: La capa acuosa supone el 95% del espesor total de la película y está segregada por las glándulas lagrimales principal y accesoria. Se encarga de la humectación y de las funciones de mantenimiento-defensa de la córnea. Finalmente la capa mucínica permite su estabilidad sobre el epitelio córneo-conjuntivo y tiene un espesor de entre 20-50 nm.

Fig. 2.1 — Elementos que conforman la anatomía del ojo [URL 1]

2.2 La córnea 15

2.2 La córnea La córnea es un tejido altamente transparente. Tiene un espesor de 0.5-0.6 mm en el centro y de 1 mm en la periferia. Su índice de refracción es de 1.376 y el radio de curvatura medio de la cara anterior es de 7.7 mm, mientras que el de la cara posterior es de 6.8 mm, lo que proporciona una potencia óptica de 43 Dioptrías (D). La córnea se compone de tres capas: el epitelio corneal de 50-56 micras de espesor y compuesto a su vez por 5-7 capas de tejido escamoso: el estroma corneal de 0.5-0.54 mm de espesor, compuesto por fibras de colágeno ordenadas en unas 200-250 láminas paralelas a la superficie corneal. Dentro de cada capa las fibras se orientan en la misma dirección, mientras que se presentan oblicuas respecto a las capas adyacentes, presentando una tendencia a la orientación vertical y horizontal. El diámetro de las fibras de colágeno (30-38 nm) y su ordenación contribuyen notablemente a la transparencia de la córnea y a su carácter birrefringente (ver apartado 2.10). Por último el endotelio, constituye una monocapa de células hexagonales que hacen de barrera de separación entre el humor acuoso y el estroma contribuyendo al correcto grado de hidratación estromal. 2.3 Humor acuoso El humor acuoso es una sustancia líquida, de índice de refracción n=1.3374, contenida en la cámara anterior, constituido fundamentalmente por agua salada. Su principal función desde un punto de vista óptico es la de servir, junto a la córnea, de filtro al infrarrojo B y C (1400-106 nm). 2.4 El iris El iris es una capa de tejido muscular altamente pigmentada que es capaz de cambiar su tamaño desde 1.6 a 8 mm aproximadamente. Sus funciones principales son: limitar la cantidad de luz que alcanza la retina, y limitar la contribución de los rayos periféricos que presentan mayor aberración óptica. 2.5 El cristalino El cristalino es una lente biconvexa de entre 20-30 D de potencia óptica, transparente y elástica. Está anclado por detrás del iris y delante del cuerpo vítreo, gracias a un sistema de fibras que se denomina Zónula de Zinn, y que a su vez esta enganchada en el cuerpo ciliar. Mediante el músculo ciliar se controla la tensión que se ejerce sobre la zónula y por tanto la curvatura de las caras de

16 2.5 El cristalino

cristalino. Al cambio de potencia del cristalino se le llama acomodación y es el mecanismo que permite al ser humano enfocar a distintos planos. El cristalino está constituido por una serie de capas de células que le confieren la propiedad de ser un medio de gradiente de índice. Aún no se conoce con suficiente precisión su distribución pero se estima que en el centro su valor es de 1.415 mientras que en la periferia es de 1.37. 2.6 Humor vítreo El humor vítreo es un líquido viscoso transparente, de índice de refracción n=1.3360, que rellena el cuerpo vítreo. 2.7 La retina La retina constituye el elemento detector de radiación, es la encargada de transducir la señal luminosa en señal eléctrica que pueda interpretar nuestro cerebro. Se compone de dos capas básicas: la capa neural, que es una capa interna que contiene los fotorreceptores: y el epitelio pigmentario de la retina, que es una capa externa que descansa sobre la capa coriocapilar de la coroides. La capa neural de la retina esta constituida por diez capas celulares en orden anteroposterior: capa limitante interna, capa de fibras nerviosas o de Henle, capa de células ganglionares, capa plexiforme interna, capa nuclear interna, capa plexiforme externa, capa limitante externa, capa de conos y bastones, epitelio pigmentario.

Figura 2.2: Capas de la retina con las células más importantes que se encuentran en esas ca

[URL 2]

2. La retina 17

Desde un punto de vista óptico, la luz incidente que alcanza la retina sufre una fuerte reflexión en la capa limitante interna. La luz reflejada mantiene el grado de polarización de la luz incidente. La luz que se trasmite atraviesa las siguientes capas hasta llegar a la capa de conos y bastones, donde parte de la luz es absorbida por estas células fotosensibles, mientras que otra parte se sigue propagando hasta llegar al epitelio pigmentario. En esta capa se produce una fuerte absorción de la luz debido a la presencia de melanina. Gracias a esta absorción se evita luz reflejada en las capas posteriores a la de conos y bastones. A pesar de la fuerte absorción cierta cantidad de luz se transmite hasta llegar a la coroides. Es importante resaltar que la luz que llega a los fotorreceptores primero debe atravesar todas las capas mas internas de la capa neural de la retina. La capa de los conos y bastones es fundamental para el proceso visual ya que como dijimos es donde se realiza la transducción de la señal luminosa en señal eléctrica. La retina contiene en torno a 120 millones de bastones y 7 millones de conos dispuestos en forma de empalizada. La distribución espacial de los fotorreceptores no es uniforme. Así, la fóvea se encuentra únicamente constituida por conos con una densidad de 150000/mm2 en su parte central, disminuyendo la densidad a medida que nos alejamos. De esta forma la fóvea es la zona de la retina donde hay mayor muestreo espacial de la imagen formada por el sistema óptico ocular.

Figura 2.3: Densidad de conos en la retina en función de la excentricidad. [Roo02B]

18 2.7 La retina

Diferencias funcionales entre los conos y los bastones son: su tamaño siendo mas grandes los bastones, de forma que los conos permiten realizar la visión en detalle; su respuesta temporal siendo los bastones más rápidos que los conos, de forma que son los primeros los que se usan para detectar el movimiento; su respuesta luminosa, siendo los bastones mas sensibles (encargados de la visión nocturna) y los conos encargados de la visión en color, existiendo tres tipos diferenciados de conos atendiendo a su respuesta espectral conos S (azul), M (verde), L (rojo). 2.8 La coroides La coroides es una capa de color pardo oscuro que mide 0.25 mm en la parte posterior y 0.1mm en la anterior. Se localiza entre la esclerótica y la retina. Consta de dos capas: la capa coriocapilar (interna y vascular); la membrana de Bruch (delgada amorfa e hialina). En la porción interna de la coroides predominan los vasos grandes y melanocitos grandes y muy pigmentados que posibilitan la absorción de los rayos de luz que volverían reflejados y dispersados hacia la retina. 2.9 La esclerótica La esclerótica esta formada por haces de colágeno aplanados que transcurren en varias direcciones paralelos a la superficie. Los haces de colágeno y fibrillas que los componen tiene diámetros y disposiciones irregulares. 2.10 Transmisión, Absorción, Reflexión, Polarización y Dispersión La óptica del ojo humano interactúa con la luz que entra en el ojo de forma que ésta sufre procesos de transmisión, reflexión, esparcimiento y absorción. En la figura 2.3(a) mostramos el espectro de transmisión de los distintos medios oculares. Como se puede observar actúan como filtros pasabanda que en su conjunto consiguen atenuar fuertemente (mediante procesos de absorción) todas las longitudes de onda excepto las pertenecientes al espectro visible. Por otra parte en la figura 2.3 (b) mostramos el espectro de absorción de los distintos pigmentos retinianos: Pigmentos maculares MP, P410-P435, Hemoglobina (HbO2), Melanina. Estos pigmentos son los encargados de: absorber la luz esparcida a través de las distintas capas de la retina y coroides, con el fin de aumentar el contraste de las imágenes detectadas por los fotorreceptores; de absorber gran parte del espectro inferior a 400nm previniendo la aparición de daños por exposición al ultravioleta; y reducir el efecto de la aberración cromática

2.10 Transmisión, absorción, reflexión, polarización y dispersión 19

producida por luz perteneciente a ese rango de longitudes de onda. Del mismo modo la distribución espacial de estos pigmentos es determinante para las características del espectro de reflexión ocular [Del89]. Por otra parte la capa limitante interna y la capa de fibras nerviosas dificultan (debido a su estructura y propiedades ópticas) la correcta validación del verdadero espectro de reflexión del fondo ocular [Els92]. En la figura 2.4 presentamos una serie de espectros de reflexión en distintas posiciones de la retina correspondientes a 5 personas distintas donde se muestra el efecto mencionado. La figura 2.4 muestra como la reflectancia del fondo ocular aumenta con la longitud de onda hasta llegar al infrarrojo cercano. También se observa la variación existente entre sujetos y la dependencia con la zona retiniana. Al igual que el espectro de absorción, el de reflexión se ve fuertemente afectado por la cantidad de melanina presente en la coroides. Con luz roja y con bajos niveles de pigmentación la mayor parte de la luz reflejada se debe a la coroides altamente vascularizada, que provoca la manifestación de las bandas de absorción de la hemoglobina. A medida que el grado de pigmentación aumenta, el espectro de absorción de la melanina domina al de la hemoglobina. Con luz verde o azul, la contribución de las reflexiones en la coroides es pequeña comparada con las reflexiones originadas en las capas de la retina. El espectro de reflexión muestra igualmente la influencia del pigmento macular en el rango del azul.

Figura 2.3 : (a) Espectro de transmisión de los distintos medios oculares. [Roo02B] .(b): Espectro de absorción de los distintos pigmentos retinianos [Roo02B]

(a) (b)

20 2.10 Transmisión, Absorción, Reflexión, Polarización y Dispersión

Por último trataremos la interacción de los medios ópticos oculares con la luz polarizada. Hasta hoy en día se desconoce la utilización por parte del sistema visual humano del estado de polarización de la luz incidente. Pero si se sabe que el ojo (y muy en particular la córnea) modifican el estado de polarización de la luz. Se ha comprobado que la córnea modifica el estado de polarización de la luz. De los modelos existentes el más sofisticado presenta la córnea como un sistema biáxico [Roo02B]. Esta naturaleza biaxial de la córnea se debe a la orientación de las distintas láminas de fibras de colágeno que conforman el estroma corneal. El cristalino presenta igualmente cierto grado de polarización aunque sustancialmente menor que el corneal [Bue03]. En cuanto a la retina, presenta una interacción con la luz polarizada un poco más compleja que la córnea o el cristalino. La complejidad se debe a su estructura en capas diferenciadas. Así por una parte la capa limitante interna se comporta como una superficie reflectante manteniendo el grado de polarización incidente. El epitelio pigmentario retiniano (EPR) y la membrana de Bruch (MB) presentan cierto grado de brirrefringencia induciendo un retardo aleatorio entre las componentes del campo eléctrico. Más aún estas capas presentan características diferenciadas respecto a la luz dispersada hacia atrás. Mientras el EPR mantiene el estado de polarización incidente la MB provoca la despolarización de la luz. La capa que contiene las fibras de Henle también presenta birrefringencia, al igual que la capa de fibras nerviosas. Finalmente aunque no forme parte de la retina mencionamos aquí la esclera, la cual presenta también cierto grado de birrefringencia [Mor98, Pir04].

Figura 2.4: Espectro de Reflexión para 5 sujetos en tres posiciones distintas de la retina: (N) nasal, (P) Perifovea, (F) Fovea. Obtenida de la referencia [Del89]

2.11 Efecto Styles-Crawford 21

Este comportamiento de la retina frente a la luz polarizada puede ser aprovechado como ya indicamos en el capítulo anterior, para mejorar la calidad de las imágenes obtenidas del fondo ocular y facilitar la identificación de distintas estructuras retinianas de interés oftalmológico. Esta es la base de la técnica de imagen polarimétrica. Relacionado con el proceso de despolarización se encuentra la dispersión. Ya hablamos de ella en el primer capítulo pero no está de más realizar un breve recordatorio en este apartado en el que tratamos la interacción de la luz con los medios oculares. La dispersión de luz ocurre siempre que la luz encuentra discontinuidades en el índice de refracción. Ésta depende del tamaño relativo de la estructura respecto a la longitud de onda de la radiación incidente. Para el proceso visual la dispersión de luz en el sentido de propagación es la más importante ya que reduce el contraste de las imágenes registradas por los fotorreceptores. Sin embargo para la observación del fondo ocular afectan por igual tanto la dispersión en el sentido de propagación de la luz como la que se produce en sentido contrario. Las principales fuentes de dispersión en el ojo humano en cuanto a la luz retrodispersada son: posibles opacidades en la cornea o cristalino, cuerpos opacos en el humor vitreo, [Hem92], retina (vasos, membrana Bruch [Els00, Pir04]), coroides (vasos sanguíneos, melanocitos, pigmentos oculares...), y esclera [Del89, Els92, Roo02B]. 2.11 Efecto Stiles-Crawford El efecto Stiles-Crawford se describió por primera vez en 1933. Inicialmente se enunció de la siguiente forma: “El efecto Stiles-Crawford (SC) se refiere a la observación experimental relacionada con la mayor eficiencia a la hora de producir una respuesta visual, de la luz que entra cerca del centro de la pupila que la luz que entra por las zonas periféricas” [App93]. El origen de dicho efecto es consecuencia directa de la estructura anatómica de los fotorreceptores, que provoca que se comporten como guías ópticas, de forma que la eficiencia en el guiado de la luz hacia la zona interior del fotorreceptor donde se encuentra el pigmento fotosensible depende del ángulo de incidencia de la luz [Roo02B]. Pero el SC también se manifiesta en la luz reflejada, produciendo una distribución de irradiancia no uniforme sobre la pupila ocular [Mar96]. De forma que a pesar de

22 2.11 Efecto Styles-Crawford

tener un origen retiniano el efecto resulta equivalente a una pupila apodizante de transmisión inhomogénea cuyo máximo se sitúa próximo al centro pupilar y su amplitud decrece al alejarse hacia el borde. Del efecto SC podemos extraer información de dos magnitudes: la orientación media de los fotorreceptores iluminados, magnitud que se valora a partir de la posición del máximo de la función de SC; y la direccionalidad, u orientación relativa entre los fotorreceptores iluminados, que se estima a partir del ancho de la función de SC [App93, Mar96]. Al ser un efecto de origen retiniano es evidente que va a presentar gran variabilidad entre sujetos, zonas de la retina analizadas, y propiedades estructurales del ojo. De entre los distintos modelos matemáticos empleados para describir el efecto SC nosotros escogemos como ejemplo el propuesto por Applegate et.al [App93,].

2

maxmax10 ρζ ζ − −= r r 2.1

donde ζ representa la irradiancia en una posición de la pupila dada, |r-rmax|

determina la distancia entre el punto de observación y la posición en la que se produce la irradiancia máxima, y ρ es un parámetro denominado factor de forma.

En la figura 2.5 mostramos el aspecto de la función de SC presentada.

Desde un punto de vista perceptivo el efecto SC es interesante ya que al reducir el peso de los rayos que inciden en la retina, procedentes de zonas periféricas de la pupila, se aumenta la profundidad de foco del ojo y se reduce el efecto de las aberraciones sobre la imagen que se forma sobre la retina [Roo02B].

Figura 2.5 : Efecto Stiles-Crawfored ideal representado como el logaritmo de la sensibilidad relativa en función de la posición de entrada en una pupila de 8 mm de diámetro [App93].

CAPÍTULO 3 23

CAPÍTULO 3

MEDIDA DE ABERRACIONES OCULARES

En este capitulo trataremos la medida de las aberraciones ópticas oculares. Empezaremos presentando el concepto de aberración de onda así como una serie de formas de representarla, incidiendo especialmente en la representación en base a polinomios de Zernike. Posteriormente nos centraremos en el origen y características tanto poblacionales como espacio-temporales de la aberración ocular. Seguidamente realizaremos un repaso histórico de la evolución sufrida por los métodos de medida de aberraciones oculares. A continuación describiremos en detalle los fundamentos de los sensores de gradiente, haciendo especial hincapié en el sensor Hartmann-Shack. Analizaremos el principio físico fundamental de su funcionamiento, en el que incluiremos el procesado por umbralización normalmente empleado en el procesado de la imagen proporcionada por el sensor. Estudiaremos las distintas fuentes de error que afectan al sensor: errores sistemáticos, errores en la determinación del centroide (donde volveremos a incluir el procesado por umbralización) y los errores relativos a la construcción del estimador. Posteriormente analizaremos la influencia de la elección del sistema de referencia sobre la estimación de la aberración ocular. Finalmente evaluaremos el efecto que tiene sobre la estimación de la MTF ocular el error cometido en la obtención de los coeficientes estimados.

24 CAPÍTULO 3

Se comprobará la relevancia significativa que el procesado por umbralización presenta tanto en la estimación del gradiente local de la fase existente sobre la pupila del sensor, como sobre la estadística del centroide en presencia de ruido aleatorio aditivo gaussiano. Veremos que incluso en ausencia de ruido, el procesado por umbralización puede provocar el desplazamiento del centroide estimado, respecto al valor que se obtendría sin umbralización, siempre que la fase incidente presentase cierto grado de aberración de tipo comática. Mostraremos como el efecto provocado por la función de umbralización empleada en el plano de detección del sensor es equivalente a una modificación de la dirección media de propagación de los rayos que atraviesan la pupila del sistema. También veremos que como consecuencia del procesado por umbralización la relación entre el gradiente de la fase y el centroide de la distribución de irradiancia correspondiente deja de ser lineal. En cuanto a los errores aleatorios que afectan a la determinación del centroide nos centraremos en la presencia de ruido aditivo gaussiano en el plano del detector. Veremos que en presencia de umbralización el ruido gaussiano que afecta a las distribuciones focales proporcionadas por el sensor cambia sus propiedades estadísticas dependiendo de tres factores: nivel de ruido, nivel de irradiancia y valor de umbral en el píxel. Como consecuencia de este cambio en las propiedades estadísticas del ruido se comprobará que por una parte el valor medio del centroide puede ser desplazado respecto al valor esperado, y por otro lado la varianza va a presentar un comportamiento no monotónico, pudiendo así establecer un valor de umbral que minimice la varianza del centroide, lo que permitirá la reducción del ruido del sensor en aquellas situaciones en las que el valor medio del centroide coincida con el que obtendríamos en ausencia de ruido y procesado por umbralización. Compararemos así la incertidumbre en la determinación del centroide obtenida a partir del nivel de umbral que la minimiza y tres métodos de umbralización más, comprobando que el menor valor de la varianza lo proporciona el método por nosotros propuesto. Siguiendo con el análisis de las fuentes de error veremos la importancia del correcto modelado del problema a la hora de construir la matriz de reconstrucción de mínimos cuadrados. Aquí incluimos la importancia de tanto modelar bien las medidas que proporciona el sensor, como de conocer las propiedades del espectro modal de la aberración analizada.

3.1 Representación de la aberración de onda 25

Mostraremos igualmente la equivalencia entre estimar la aberración ocular respecto a un sistema de coordenadas solidario a la pupila del ojo y cualquier otro mediante el empleo de una matriz de cambio de base aplicada sobre los coeficientes estimados. Dicha equivalencia será únicamente verificada para transformaciones de coordenadas lineales conformes. Finalmente describiremos como se construye la matriz de transformación que permite relacionar los coeficientes estimados respecto a los sistemas de coordenadas señalados anteriormente. Por último mostraremos el efecto que tiene equivocarse en la estimación de los coeficientes modales sobre la MTF ocular. Veremos, a la luz de las simulaciones realizadas, que el efecto de modelar mal las medidas del sensor es reducido. Igualmente comprobaremos que al considerar que el frente tiene menos modos de los que realmente tiene, la MTF ocular se subestima mientras que el ruido en las medidas produce su sobreestimación. 3.1 Representación de la aberración de onda La aberración de onda se define como la diferencia de camino óptico entre el frente de ondas aberrado y un frente de ondas ideal de referencia, existente en el plano de la pupila. En el caso del ojo humano, y siguiendo las recomendaciones del estándar VSIA-OSA [Thi00] tomaremos como plano de observación el plano de la pupila de salida del ojo (visto desde el sensor). Nos centraremos en este trabajo en las aberraciones monocromáticas. Existen varias posibilidades para describir la aberración de onda correspondiente a un sistema óptico. Una de ellas consiste en expresar la aberración de onda en función de las aberraciones Seidel [Wel86, Mal92, Bor92], pero la opción más extendida, empleada para tal fin, es la base de polinomios de Zernike [Mal92, Bor92]. 3.1.1 Polinomios de Zernike Los polinomios de Zernike constituyen la base de polinomios más usada para representar la aberración de onda de un sistema óptico. Presentan una serie de propiedades matemáticas que los hacen especialmente interesantes [Bor92, Mal92, Wya92]: (1) Son ortogonales dentro del circulo de radio unidad; (2) Constituyen una base completa, esto quiere decir que cualquier frente obtenido por una función cuadrado integrable puede ser descrito mediante una combinación lineal de dichos polinomios; (3) Se pueden expresar como producto de dos funciones independientes

26 3.1 Representación de la aberración de onda

donde una lleva información radial y la otra información angular: (4) Son invariantes en su forma a rotaciones del eje de coordenadas respecto a su origen; (5) Exceptuando el primer término cada polinomio de Zernike tiene como valor medio cero; (6) La varianza de la aberración de onda es igual a la suma de las varianzas de cada uno de los polinomios de Zernike que la componen; (7) Son fácilmente generables tanto en coordenadas polares como cartesianas: (8) Permiten la obtención de un polinomio de amplitud variable mediante la suma de dos polinomios iguales pero rotados, de forma que la amplitud del polinomio resultante está relacionada directamente con el ángulo de rotación [Aco05]. La definición de los polinomios de Zernike en coordenadas polares según el Standard VSIA-OSA [Thi00] es la siguiente:

( ) cos( ) para m 0( , )

( ) sin( ) para m<0

m mn nm

n m mn n

N R mZ

N R m

ρ θρ θ

ρ θ

⎧ ≥⎪= ⎨−⎪⎩

(3.1)

donde la componente radial mnR viene dada por:

( )

22

0

( 1) ( )!( )

! ! !2 2

n ms

m n sn

s

n sR

n m n ms s s

ρ ρ

−

−

=

− −=

⎡ + ⎤ ⎡ − ⎤− −⎢ ⎥ ⎢ ⎥

⎣ ⎦ ⎣ ⎦

∑ (3.2)

y el factor de normalización mnN :

0

2( 1)1

mn

m

nNδ+

=+

0 01 si m=0, y 0 si m 0m mδ δ= = ≠ (3.3)

A pesar de que esta definición es cómoda para trabajar y analizar las propiedades de los polinomios de Zernike, la representación en coordenadas cartesianas se esta imponiendo en el campo de la aberrometría ocular, principalmente porque los sensores de frente de onda proporcionan medidas del gradiente según los ejes cartesianos, de forma que expresar los polinomios de Zernike en cartesianas facilita la interpretación directa de las medidas y la implementación computacional del algoritmo de computo de coeficientes modales. Pero así como la representación de los polinomios de Zernike en coordenadas polares solo hay una, en cartesianas hay varias atendiendo sobre todo a como se definan los ejes de coordenadas y el ángulo de la notación polar. Según el Standard VSIA-OSA la definición de los ejes cartesianos es la siguiente cos ; sinx yρ θ ρ θ= =

3.2 Aberraciones oculares 27

[Thi00]. Según esta definición de los ejes el generador de polinomios de Zernike en coordenadas cartesianas es:

2( ) 2( )

0 0 0

( )!( 1)

!( )!( )!

q m jmm m i j i k p n i j k pn n

i j k

n jZ N y x

j m j n m j

−+ + + − + + −

= = =

−= −

− − −∑∑∑ (3.4)

Esta expresión es una modificación de la presentada por Malacara [Mal92] en la que intercambiamos x por y para adaptarla al Standard VSIA-OSA. La obtención de los valores de los distintos índices presentes en la expresión (3.4) se encuentra descrita en el APENDICE A. 3.2 Aberraciones oculares Hasta el momento hemos presentado de forma muy general las aberraciones. En esta sección desarrollaremos en más detalle su descripción. Así hablaremos del origen de las aberraciones oculares, de la estadística temporal de la aberración en individuos e incidencia poblacional y de la evolución de las distintas técnicas de medida empleadas en su caracterización. 3.2.1 Fuentes de aberraciones oculares Como avanzamos en el primer capítulo, la aberración ocular se puede dividir en dos componentes [Hof01, Che04]. Por una parte encontramos una componente de evolución temporal lenta, comúnmente denominada estática (principal responsable de la aberración ocular) y por otro lado una componente de evolución temporal más rápida, conocida como componente dinámica. Las principales fuentes de estas aberraciones incluyen la lágrima, la córnea y el cristalino. Además de las aberraciones de primer y segundo orden el ojo humano también presenta lo que denominamos aberraciones de alto orden provocadas por posibles irregularidades en sus superficies refractoras y a posibles descentramientos o inclinaciones relativas entre los distintos elementos ópticos oculares [Lia94, Nav97, Lia97, Roo02B, Thi02]. De estas aberraciones de alto orden la principal causante es la córnea. Pero ésta y el cristalino no solo inducen aberraciones sino que en cierta medida se compensan entre sí. Estudios simultáneos de la topografía corneal y de la aberración ocular sugieren que el cristalino no sólo permite enfocar distintos planos sino que además compensa parte de la aberración óptica inducida por la córnea [Art01, Kel04].

28 3.2 Aberraciones oculares

Por otra parte la componente dinámica presenta una magnitud sustancialmente inferior a la estática. Su fluctuación temporal se produce en intervalo de tiempos mucho menores que el segundo, por lo que sus fuentes deben mostrar cambios temporales de la misma escala de tiempos. Hasta el momento no se ha completado la identificación de todos los mecanismos involucrados, aunque algunos ya han sido identificados [Hof01, Zhu04, Dub04]: la lágrima, posibles desplazamientos longitudinales de la retina debido a la presión vascular, movimientos oculares, y desplazamientos axiales y microfluctuaciones del cristalino inducidos tanto por la presión vascular como por la presión intraocular. Así pues hemos presentado en este apartado los principales responsables de la aberración ocular. A continuación seguiremos el estudio de estas aberraciones aunque desde un punto de vista estadístico. Primero presentaremos un análisis poblacional que nos indicará la incidencia de las distintas aberraciones. Posteriormente nos centraremos en la estadística temporal de la aberración ocular. 3.2.2 Estadística Poblacional y Temporal Al hablar de estadística de las aberraciones oculares podemos realizar dos tipos de estudios. Por una parte nos puede interesar analizar cuál es la dinámica temporal de las aberraciones oculares, estudio que es importante por ejemplo para analizar la utilidad de compensar con elementos ópticos estáticos las aberraciones de alto orden. Pero por otro lado puede ser interesante conocer la incidencia de las distintas aberraciones, con el fin de optimizar el diseño de aberrómetros o determinar cuales son los valores normales e inferir a partir de ahí la presencia o no de patologías. 3.2.2.1 Estadística Poblacional Como dijimos en apartados anteriores el conocimiento de la incidencia de las distintas aberraciones es de gran importancia, para el diseño de aberrómetros y caracterización de patologías oculares entre otras aplicaciones. Con este fin se han realizado numerosos estudios en distintas partes del mundo que han proporcionado resultados muy similares [Por01, Thi02, Cas02, How02]. En el trabajo de Thibos [Thi02] se muestra mediante histogramas la distribución de valores de las distintas componentes de Zernike de las aberraciones oculares correspondientes a una población de 200 ojos. Estos resultados concuerdan con los obtenidos por otros estudios realizados igualmente sobre un gran número de ojos

3.2 Aberraciones oculares 29

[Cas02, Por01]. Según estos resultados la aberración ocular sigue una distribución de probabilidad gaussiana de valor medio igual a cero en la mayoría de las componentes de la aberración. Únicamente el desenfoque 0

2Z , el astigmatismo a

favor de regla 22Z , y la aberración esférica 0

4Z presentan un valor medio

significativamente distintos de cero [Thi02, Cas02, Por01]. Es importante resaltar que el valor medio de la mayoría de las componentes es nulo en término medio, pero la probabilidad de que exista un sujeto sin aberraciones ópticas de bajo y alto orden es despreciable. Por otra parte el trabajo de Thibos mencionado anteriormente [Thi02] muestra también el valor medio de las distintas componentes de la aberración ocular, pudiéndose observar su decrecimiento a medida que avanzamos en el orden modal. En otros estudios poblacionales realizados por Castejon y Porter se llega a resultados equivalentes a los obtenidos por Thibos en cuanto al valor medio de las

distintas componentes de la aberración, y a la prevalencia de 04Z sobre las otras

aberraciones de cuarto orden. En estos estudios también se destaca: la correlación existente entre la aberración esférica de cuarto orden y las aberraciones de segundo orden: la correlación entre las componentes de segundo y tercer orden de los dos

ojos del sujeto: y la prevalencia del astigmatismo 22Z a favor de regla [Thi02,

Cas02, Por01]. Todos los estudios muestran la relevancia de las aberraciones de 2o orden (responsables del 90% de la aberración en pupilas de 5mm) y 3er orden (8% del total de la aberración) [Cas02]. También concluyen que el aumento del tamaño pupilar esta correlacionado con un aumento significativo de la aberración y en particular con el de las componentes de orden alto.

3.2.2.2 Estadística Temporal La dinámica de las aberraciones oculares como se dijo anteriormente aún no esta totalmente caracterizada. Por el momento no se conocen totalmente los mecanismos que provocan dicha fluctuación pero sí se conocen una serie de características [Kot86, Gra00, Hof01, Dia03, Nir03, Zhu04]:

• La fluctuación temporal de las aberraciones es similar entre sujetos. • El espectro de potencias temporal de la aberración decae según un

exponente -4/3 de la frecuencia, decayendo todas las componentes modales de la misma forma.

30 3.2 Aberraciones oculares

• Se han observado fluctuaciones de la aberración de hasta 70 Hz. • La fluctuación está correlacionada con el ritmo cardiaco y respiratorio a

través del cristalino presentando dos frecuencias de oscilación características a 2 Hz y 0.5 Hz respectivamente.

• Las aberraciones de alto y bajo orden cambian con la acomodación. De las fuentes que originan la fluctuación y que han sido identificadas hasta el momento las de mayor relevancia son cambios en el cristalino y en la lágrima. Como dijimos anteriormente tanto el ritmo cardíaco como respiratorio están altamente relacionados con las microfluctuaciones de la aberración, siendo ambos responsables de la existencia de dos picos en el espectro temporal de la fluctuación de la aberración, situados en 0.5 Hz (ritmo respiratorio) y 2 Hz (ritmo cardiaco) [Kot86]. Esta relación se debe a que el pulso sanguíneo actúa sobre el cristalino, probablemente contrayendo/relajando el músculo ciliar por la presión de la sangre a su paso, o desplazando el cristalino con los cambios en la presión intraocular [Kot86, Gra00, Zhu04]. Igualmente se comprobó que cambios en el ritmo respiratorio inducen modificaciones en la frecuencia de la fluctuación de la aberración según recoge el trabajo de Zhu et.al. [Zhu04]. Otro elemento importante en la estadística temporal de la aberración ocular, que está relacionado con el cristalino, es el proceso de fijación. Durante la medida de aberraciones oculares el sujeto debe fijar a un punto o un objeto, de forma que se espera que mantenga constante su estado refractivo (y por tanto su acomodación). Pero es sabido que el ojo sufre microfluctuaciones de la acomodación no sólo involuntarias como las inducidas por el ritmo cardiaco y respiratorio sino también pseudocontroladas, relacionadas con el proceso de fijación, proceso en el que se trata de obtener y mantener la mejor calidad de imagen. Este proceso depende entre otros factores de la ametropía del sujeto, del tipo de test de fijación y de su luminancia [Sta03, Cha78, Gra00]. Así que la capacidad de fijación será otro factor a tener en cuenta en el análisis temporal. Por otra parte se encuentra la lágrima. Ésta se comporta como un sistema dinámico en el que el proceso de extensión de la lágrima sobre la superficie corneal y conjuntival, y el consiguiente comienzo de su evaporación provocan cambios significativos en su superficie anterior. Se ha comprobado que este proceso dinámico presenta un mínimo en la generación de aberraciones, que se produce en término medio 6 segundos después del parpadeo [Mon04]. En cuanto a su estadística temporal se ha comprobado que por lo menos es capaz de presentar fluctuaciones de hasta 25Hz, pudiendo alcanzar mayores frecuencias [Kas02].

3.2 Aberraciones oculares 31

Respecto a la magnitud de las fluctuaciones inducidas por la dinámica lagrimal existe cierta disparidad entre los resultados presentados en distintos estudios. Por ejemplo en el trabajo de Dubra [Dub04] se indica que la lágrima es responsable de una fluctuación de la aberración de 0.06 μm rms en pupilas de 3 mm de diámetro. Sin embargo en el trabajo de Montes-Micó [Mon04, Mon04B] se indica que la fluctuación puede llegar a ser de hasta 1 μm rms en pupilas de 7 mm de diámetro. La variabilidad en los resultados obtenidos en los estudios de la fluctuación de la aberración ocular debida a la dinámica lagrimal pone de manifiesto la relevancia de una serie de factores que hay que tener en cuenta a la hora de su comparación: duración de las series de medidas; el tiempo entre el último parpadeo y el comienzo de la serie de medidas; y tiempo de ruptura lagrimal de los sujetos entre otros factores. Hasta ahora sólo hemos presentado posibles fuentes que originen las consabidas fluctuaciones temporales de la aberración ocular. ¿Pero cuál es la magnitud de la fluctuación? ¿Es interesante la corrección estática de aberraciones de alto orden? ¿Se puede emplear óptica adaptativa en relación con el ojo humano? Estas preguntas las responderemos a continuación. De los estudios relacionados con la dinámica de las aberraciones oculares destacamos los realizados por H. Hofer [Hof01, Hof01B]. En estos estudios Hofer analiza pormenorizadamente la amplitud de la fluctuación tanto de la aberración total como de cada uno de sus componentes, el espectro de potencias de la fluctuación, y la posibilidad de emplear óptica adaptativa y corrección estática para obtener imágenes de buena calidad del fondo de ojo. Los resultados que presenta para un sujeto con diámetro pupilar de 4.7 mm muestran que la amplitud de la fluctuación del rms de la aberración es de 0.2-0.3 μm, siendo la componente principal de dicha fluctuación las microfluctuaciones de la acomodación. Viendo la diferencia entre la contribución del desenfoque (directamente relacionado con la acomodación) y la fluctuación total se observa que el residuo es de aproximadamente 0.1 μm. Hofer también presenta el hecho de que un sistema adaptativo trabajando a 1-2 Hz sería capaz de proporcionar imágenes limitadas por difracción, de forma que muestra el reducido impacto que las aberraciones que fluctúan a mayor frecuencia tienen sobre la PSF ocular. En esta línea apunta la utilidad de corregir aberraciones de alto orden con componentes estáticos.

32 3.2 Aberraciones oculares

Creemos interesante comentar el hecho de que un sistema adaptativo trabajando a 2 Hz proporcione imágenes limitadas por difracción, ya que es indicativo del papel relevante que las microfluctuaciones del cristalino provocadas por el ritmo cardiaco (cuya frecuencia característica es de 0.5-2 Hz) tienen en la estadística de las fluctuaciones de la aberración.

En la fig. 3.1 mostramos la evolución temporal de las aberraciones del ojo derecho del sujeto JAP para dos series de medidas distintas. Se observa con gran claridad la oscilación rítmica de la aberración descrita en la literatura [Kot86, Gra00, Zhu04]. Con el fin de comprobar si los picos presentes en la aberración coinciden con el ritmo cardíaco del sujeto calculamos su frecuencia cardíaca, para ello contamos su número de pulsaciones durante un minuto. El sujeto presentó una frecuencia de latido de 0.7 Hz lo que corresponde con tres latidos cada 5 segundos. Comparando esta estimación con la figura 3.1 (a),(b) observamos (sobre todo en el caso (b)) que el número de picos presentes cada cinco segundos es el mismo, lo que muestra el gran peso que tienen las microfluctuaciones del cristalino (provocadas por el pulso cardíaco) sobre la fluctuación de la aberración y en particular sobre la componenete de desenfoque. Superpuesto al efecto de la microfluctuación del desenfoque se puede observar la presencia de cierta deriva acomodativa en el rms de la figura 3.1a en contraposición al caso presentado en fig.3.1b. El control de este proceso de deriva va a ser indispensable a la hora de realizar análisis temporales de la fluctuación de la aberración para poder llegar a conclusiones correctas.

rms total

desenfoque

rms total

desenfoque

(b) (a)

rms (

µm)

rms (

µm)

t (sec)t (sec)

Figura 3.1: (a)-(b) Evolución temporal del rms total (sólida) y del rms de la fluctuación del desenfoque (línea discontinua) correspondiente a dos series aberrométricas distintas. Los datos aberrométricos fueron obtenidos con un diámetro pupilar 6.4 mm.

3.3 Medida de aberraciones oculares 33