Modelo Lineal Y p X ,,X . Esta metodolog´ıa es ampliamente ...mate.dm.uba.ar/~drodrig/modelo...

Transcript of Modelo Lineal Y p X ,,X . Esta metodolog´ıa es ampliamente ...mate.dm.uba.ar/~drodrig/modelo...

Modelo Lineal

En regresion lineal interesa establecer la relacion entre una variable dependienteY y otras p variables: X1, . . . , Xp. Esta metodologıa es ampliamente usada enproblemas de economıa, de la industria y de ciencias en general. Por ejemplo:

• en mujeres de 8 a 25 anos se desea relacionar la edad y la cantidad deesteroides presentes en plasma.

• dadas las evaluaciones de mitad y de fin de ano de alumnos que participanen un estudio de rendimiento, se quiere relacionar la performance de losalumnos en los dos examenes. El objetivo es poder predecir en situacionessimilares como le ira a un alumno en la evaluacion final a partir de lo que seobserva en la evaluacion de mitad de curso.

1

Modelo Lineal A. M. Bianco FCEyN 2013 2

• un ingeniero esta interesado en la relacion entre la cantidad de oxido quese forma en un metal calcinado en un horno y la temperatura de horneadoy el tiempo expuesto a dichas temperaturas.

En los dos primeros ejemplos podrıamos tener graficos como los siguientes:

Modelo Lineal A. M. Bianco FCEyN 2013 3

mitad

final

60 70 80 90 100

6070

8090

edad

nive

l.est

eroi

de

10 15 20 25

510

1520

2530

Modelo Lineal A. M. Bianco FCEyN 2013 4

En los dos primeros ejemplos consideramos solo dos variables, mientras que enel tercero hay 3 variables involucradas.

En general tendremos:

• y : variable dependiente.• x : variables independientes (predictoras, regresoras o covariables).

Buscaremos un modelo que exprese a la variable dependiente en terminos delas variables independientes.

Cuando hablamos de un modelo nos referimos a una expresion matematica quedescriba en algun sentido el comportamiento de la variable de interes en funcionde las demas variables, es decir, las covariables.

En general, identificaremos con la letra Y (y) a la variable dependiente. El mo–delo pretende describir como el comportamiento de E(Y ) varıa bajo condicionescambiantes de las otras variables.

Modelo Lineal A. M. Bianco FCEyN 2013 5

En nuestro caso, supondremos, al menos en un principio, que V (Y ) no esafectada por estas condiciones cambiantes, es decir toma un valor constanteσ.

Bajo el supuesto de que otras variables aportan informacion sobre la variableY , estas variables son incorporadas al modelo como variables independientes.

Identificaremos con X = (X1, . . . , Xp)′ (x = (x1, . . . , xp)′) a las variables

independientes. Estas podrıan ser variables aleatorias o constantes conocidas.En general, trabajaremos bajo este ultimo caso y mas adelante lo extenderemosal caso de variables aleatorias.

Una forma general de plantear el modelo es expresando a la media de la dis-tribucion de Y como una g(x). En el caso de covariables alestorias como

E(Y |X = x) = g(x) para x ∈ D ,

o en el caso de covariables fijas como

Modelo Lineal A. M. Bianco FCEyN 2013 6

Y = g(X1, . . . , Xp) + ε ,

segun el caso, donde la funcion g en general no sera conocida y E(ε) = 0.

Los modelos de este tipo se llaman modelos de regresion. Las posibles funcionesde regresion g pertenecen a una clase G tan grande que es frecuente que sesimplifique el problema suponiendo cierta forma o ciertas propiedades de lafuncion de regresion g.

Una forma de simplificar el problema suponiendo que la familia G puede expre-sarse en funcion de un numero finito de constantes desconocidas, a estimar,llamadas parametros, que controlan el comportamiento del modelo. En estesentido diremos que el modelo de regresion es parametrico.

Se dira que el modelo de regresion es no parametrico si la familia G no puedeexpresarse en un numero finito de parametros.

Modelo Lineal A. M. Bianco FCEyN 2013 7

Algunos ejemplos de modelos parametricos y no parametricos cuando hay dosvariables independientes X1 y X2.

Modelos parametricos

(i) Y = θ1X1 + θ2X2 + θ3 + ε

(ii) Y = θ1eθ2X1 + θ3e

θ4X2 + ε

(iii) Y = θ1Xθ21 X

θ32 + ε

(iv) Y = θ1 logX1 + θ2 logX2 + θ3X31 + θ4 sen X2 + ε

Modelos no parametricos

(i) Y = g(X1, X2) + ε donde g(X1, X2) es una funcion continua.

(ii) Y = g(X1, X2) + ε donde g(X1, X2) es una funcion continua y derivable.

(iii) Y = g(X1, X2) + ε donde g(X1, X2) es monotona creciente en X1 y X2.

Modelo Lineal A. M. Bianco FCEyN 2013 8

Uno de los modelos mas sencillos es el modelo lineal, en el que los parame-tros intervienen como simples coeficientes de las variables independientes o defunciones de estas.

Es el caso de:

(i) Y = θ1X1 + θ2X2 + θ3 + ε

(iv) Y = θ1 logX1 + θ2 logX2 + θ3X31 + θ4 sen X2 + ε

En todos estos ejemplos g(x) es lineal en los parametros. No es el caso,por ejemplo, de g(x) = βoe

−β1x , conocido como creciemiento exponencial, yaque no es lineal como funcion de los parametros βo o β1.

Algunos ejemplos sencillos de modelos lineales dependientes de una sola variableson:

g(x) = βo + β1x

g(x) = βo + β1x + β2x2

g(x) = βo + β1 log x

Modelo Lineal A. M. Bianco FCEyN 2013 9

En las situaciones mas complejas Y depende de un conjunto de p variables(x1, . . . , xp), por lo tanto tendremos

g(x) = β0 + β1x1 + . . .+ βp−1xip−1 .

Eventualmente, las x ′i s podrıan ser funciones de otras variables, tales comoW1 = logX1, W2 = logX2, W3 = X

31 , etc., tal como ocurre en el caso iv).

Tambien podrıamos introducir variables explicativas que sean categoricas comolas dummies que solo toman los valores 0 y 1 y que sirven, como ya veremos,para indicar las distintas categorıas de una variable categorica. Este caso es deespecial interes pues permite tratar en el marco del modelo lineal el problema decomparar la media de mas de dos poblaciones, que se conoce como Analisisde la Varianza.

Modelo Lineal A. M. Bianco FCEyN 2013 10

Una vez establecido el modelo, nos interesara:

• Estimar los parametros desconocidos: βj y σ• Testear hipotesis del tipo

Ho : βj = 0 o Ho : c′β = δ

• Intervalos de confianza para los parametros o combinaciones lineales de losmismos.

• Prediccion• Chequeo de supuestos• Identificacion de datos atıpicos.• Medidas de ajuste• Criterios para la seleccion de modelos.

Modelo Lineal A. M. Bianco FCEyN 2013 11

Enfoque matricial

respuesta y ←→ p − 1 variables explicativas xjPor ahora, supondremos xj , 1 ≤ j ≤ p − 1 determinısticas.Muestra (xi1, . . . , xip−1, yi), 1 ≤ i ≤ n que cumplen el modelo Ω:

yi = β0 + β1xi1 + . . .+ βp−1xip−1 + εi i = 1, . . . , n

E(εi) = 0

V (εi) = σ2

cov(εi , εj) = 0 i 6= j

donde, β0, β1, . . . , βp−1 son p parametros desconocidos a estimar.

Este modelo tiene intercept u ordenada al origen, eventualmente podrıamossaber que es 0, en cuyo caso plantearıamos

yi = β1xi1 + . . .+ βp−1xip−1 + εi i = 1, . . . , n

Modelo Lineal A. M. Bianco FCEyN 2013 12

En el caso general tenemos

Y =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

y1y2..yn

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

X =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

1 x11 x12 . . . x1p−11 x21 x22 . . . x2p−1. . . . . .. . . . . .1 xn1 xn2 . . . xnp−1

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

β =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

β0β1..

βp−1

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

ε =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

ε1ε2..εn

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

⇓

Y = Xβ + ε

Modelo Lineal A. M. Bianco FCEyN 2013 13

La matriz X ∈ <n×p recibe el nombre de matriz de regresion o de diseno.

En general, se elige de tal forma que tenga rango maximo, es decir rg(X) = p,sin embargo esto no siempre es posible, como en el caso de algunos disenostratados en analisis de la varianza (ANOVA).

La teorıa que veremos no necesita que la primera columna sea de 1’s, es decirque el modelo tenga intercept, por lo tanto estudiaremos el caso general.

Modelo Lineal A. M. Bianco FCEyN 2013 14

Propiedades de vectores y matrices aleatorias

Dada una matriz V (r × s) de variables aleatorias conjuntamente distribuidasVi j con esperanza finita, definimos la matriz o vector de esperanzas como:

E(V)i j = E(Vi j)

En el caso delo modelo Ω, esto nos permite decir que el vector de errores estal que

E(ε) = 0

y que

E(εε′) = E

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

ε1ε1 ε1ε2 . . . ε1εnε2ε1 ε2ε2 . . . ε2εn. . . . . .. . . . . .εnε1 εnε2 . . . εnεn

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

= σ2I

Modelo Lineal A. M. Bianco FCEyN 2013 15

Lema: Sean A ∈ <q×r , B ∈ <s×t y C ∈ <q×t matrices constantes y V unamatriz aleatoria de dimension r × s , entonces:

E(AVB + C) = AE(V)B + C.

Matriz de Covarianza

Sea v = (v1, . . . , vn)′ un vector aleatorio de variables con E(vi) = µi y varianza

finita. Definimos la matriz de covarianza de v como:

Σvi j = Cov(vi , vj) = E[(vi − µi)(vj − µj)]

Podemos escribirla como:

Σv = E[(v − µ)(v − µ)′]donde µ = (µ1, . . . , µn)

′.

En este sentido, como E(ε) = 0, entonces hemos visto que

Σε = E(εε′) = σ2I

Modelo Lineal A. M. Bianco FCEyN 2013 16

Usaremos frecuentemente el siguiente

Lema: Sean A ∈ <m×n, una matriz constante, d un vector de constantes y vun vector aleatorio n–dimensional con matriz de covarianza Σv. Si w = Av+d,entonces:

Σw = AΣvA′ .

El modelo que presentamos mas arriba puede escribirse como:

Ω : Y = Xβ + ε E(ε) = 0 Σε = σ2I

o equivalentemente

Ω : E(Y) = Xβ ΣY = σ2I

Modelo Lineal A. M. Bianco FCEyN 2013 17

Modelo Lineal A. M. Bianco FCEyN 2013 18

¿Como estimamos los parametros?

Mınimos Cuadrados

Si los puntos en un grafico parecen seguir una recta, el problema es elegir larecta que mejor ajusta los puntos.

a) tomar una distancia promedio de la recta a todos los puntos

b) mover la recta hasta que esta distancia promedio sea la menor posible.

Si tenemos(xi , yi), 1 ≤ i ≤ n, y queremos predecir y a partir de x usandouna recta, podrıamos definir el error cometido en cada punto como la distanciavertical del punto a la recta.

Modelo Lineal A. M. Bianco FCEyN 2013 19

Modelo Lineal A. M. Bianco FCEyN 2013 20

Modelo Lineal A. M. Bianco FCEyN 2013 21

Modelo Lineal A. M. Bianco FCEyN 2013 22

Supongamos que tenemos un modelo que depende de p parametros. Sean(xi , yi) tales que

yi = g(xi , β1 . . . βp) + εi

E(εi) = 0, V (εi) = σ2, εi son independientes y la funcion g es conocidasalvo por los parametros β1 . . . βp.

Estimamos β1 . . . βp minimizando la suma de cuadrados residual, o seaˆβ = ( ˆ

β1, . . . ,ˆβp) es el estimador de mınimos cuadrados si minimiza

n∑

i=1(yi − g(xi , β1 . . . βp))2

En el caso de la regresion simple en el que g(x, β1, β2) = β1 + β2 x , mini-mizaremos:

1

n

n∑

i=1[yi − (β1 + β2xi)]2 .

Esta medida promedio se llama la suma de cuadrados residual del error para larecta. Fue inicialmente propuesta por Gauss. La recta de regresion ası definidaproduce la menor suma de cuadrados residual para el error de predecir y a partir

Modelo Lineal A. M. Bianco FCEyN 2013 23

de x y por esta razon se la suele llamar recta de mınimos cuadrados.

Consideremos para cada vector b ∈ <p el vector de residuosY − Xb .

El estimador de mınimos cuadrados de β1 . . . βp minimizan∑

i=1(yi − b1xi1 − . . .− bpxip)2 = ‖Y − Xb‖2 ,

donde ‖u‖2 = u′u = n∑

i=1u2i .

LlamemosS(b) = ‖Y − Xb‖2 = (Y − Xb)′(Y − Xb)

Definicion: un conjunto de funciones de Y, ˆβ1 =

ˆβ1(Y),

ˆβ2 =

ˆβ2(Y), . . .

ˆβp =

ˆβp(Y) que minimice S(b) es el estimador de mınimos cuadrados de β

(LS).

Modelo Lineal A. M. Bianco FCEyN 2013 24

Veremos que el LS siempre existe, pero no siempre es unico.

Derivando e igualando a 0 obtenemos las ecuaciones normales . Los esti-madores de mınimos cuadrados ˆ

β1, . . . ,ˆβp cumplen:

∂S(b)∂bk

= −2 n∑

i=1(Yi −

p∑

j=1xi jbj)xik = 0

Por lo tanto, para 1 ≤ k ≤ pn∑

i=1Yixik =

n∑

i=1

p∑

j=1xi jxikbj

n∑

i=1Yixik =

p∑

j=1bj

n∑

i=1xi jxik

Si el modelo tiene intercept, y lo escribimos como antes en terminos deβ0, . . . , βp−1, los estimadores

ˆβi cumplen

nˆβ0 +

ˆβ1

n∑

i=1xi1 + . . .+

ˆβp−1

n∑

i=1xip−1 =

n∑

i=1yi

nˆβ0

n∑

i=1xik +

ˆβ1

n∑

i=1xi1xik + . . .+

ˆβp−1

n∑

i=1xip−1xik =

n∑

i=1yixik k = 1, . . . , p − 1

Modelo Lineal A. M. Bianco FCEyN 2013 25

Estas p ecuaciones pueden escribirse como

X′Xˆβ = X′Y ,

que se conocen como ecuaciones normales.

Si X′X es no singular, la solucion es unica y resulta

ˆβ = (X′X)−1X′Y .

Ejemplo: En el caso de regresion simple tendrıamos

X′X =

⎛⎜⎜⎝1 1 1 . . . 1x1 x2 x3 . . . xn

⎞⎟⎟⎠

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

1 x11 x2. .. .1 xn

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

Modelo Lineal A. M. Bianco FCEyN 2013 26

X′X =

⎛⎜⎜⎜⎜⎜⎜⎝

nn∑

i=1xi

n∑

i=1xi

n∑

i=1x2i

⎞⎟⎟⎟⎟⎟⎟⎠

El sistema serıa ⎛⎜⎜⎜⎜⎜⎜⎝

nn∑

i=1xi

n∑

i=1xi

n∑

i=1x2i

⎞⎟⎟⎟⎟⎟⎟⎠

⎛⎜⎜⎝b0b1

⎞⎟⎟⎠ =

⎛⎜⎜⎜⎜⎜⎜⎝

n∑

i=1yi

n∑

i=1xiyi

⎞⎟⎟⎟⎟⎟⎟⎠

La inversa resulta

(X′X)−1 =1

n∑ni=1 x

2i − n2x2

⎛⎜⎜⎜⎜⎜⎜⎝

n∑

i=1x2i −

n∑

i=1xi

− n∑

i=1xi n

⎞⎟⎟⎟⎟⎟⎟⎠

y ademas

Modelo Lineal A. M. Bianco FCEyN 2013 27

X′Y =

⎛⎜⎜⎜⎜⎜⎜⎝

n∑

i=1yi

n∑

i=1xiyi

⎞⎟⎟⎟⎟⎟⎟⎠

y por lo tanto

ˆβ =

⎛⎜⎜⎝

ˆβ0ˆβ1

⎞⎟⎟⎠ =

1

nn∑

i=1(xi − x)2

⎛⎜⎜⎜⎜⎜⎜⎝

(n∑

i=1yi)(

n∑

i=1x2i )− (

n∑

i=1xi)(

n∑

i=1xiyi)

nn∑

i=1xiyi − (

n∑

i=1yi)(

n∑

i=1xi)

⎞⎟⎟⎟⎟⎟⎟⎠

entonces

b0 = y − xb1

y por otro lado

b1 =

n∑

i=1xiyi − nx y

n∑

i=1x2i − nx2

=

n∑

i=1(xi − x)(yi − y)n∑

i=1(xi − x)2

Modelo Lineal A. M. Bianco FCEyN 2013 28

Interpretacion Geometrica

Nuestro modelo plantea

Ω : E(Y) = Xβ

ΣY = σ2I

Luego, siη = E(Y) = Xβ

si xi es la i–esima columna de X entonces

η = β1x1 + β2x

2 + . . .+ βpxp

es decir que η ∈ Vr= subespacio generado por las p columnas de X: x1, . . . , xpy r es rg(X).

EntoncesmınbS(b) = mın

b‖Y − Xb‖2 = mın

z∈Vr‖Y − z‖2

Modelo Lineal A. M. Bianco FCEyN 2013 29

Modelo Lineal A. M. Bianco FCEyN 2013 30

y sabemos que se alcanza en η = b1x1 + b2x

2 + . . . + bpxp la proyeccion

ortogonal de Y sobre Vr , que sabemos que siempre existe y es unica, aunquelos bi pueden no serlo.

En terminos de las ecuaciones normales tenemos que:

X′Xb = X′Y

X′η = X′Y

Dados b1, . . . , bp funciones de Y seran un conjunto de estimadores de mıni-mos cuadrados (EMC) si y solo si X′b = η, es decir satisfacen las ecuacionesnormales.

Modelo Lineal A. M. Bianco FCEyN 2013 31

Caso en que rg(X) = p

En este caso existe la inversa de X′X, pues rg(X′X) = rg(X) = p.

De las ecuaciones normales queda:

X′Xˆβ = X′Y

ˆβ = (X′X)−1X′Y

entonces

Xˆβ = X(X′X)−1X′Y = PY = ˆY

En consecuencia el vector de residuos es:

r = Y − ˆY

= Y − Xˆβ

= Y − X(X′X)−1X′Y= Y − PY= (I− P)Y

Modelo Lineal A. M. Bianco FCEyN 2013 32

donde P = X(X′X)−1X′ ∈ <n×n es la matriz de proyeccion sobre el espaciogenerado por las columnas de X. Suele llamarse a esta matriz de proyeccionP o H (hat matrix).

Propiedades de P

Matriz simetrica e idempotente, es decir: P = P′ = P2. I − P tambien essimetrica es idempotente, es decir tambien es una matriz de proyeccion yproyecta sobre el ortogonal de Vr .

Lema:

i) P y I− P son simetricas e idempotentesii) rg(P) = tr(P) = p y rg(I− P) = tr(I− P) = n − piii) (I− P)X = 0

Modelo Lineal A. M. Bianco FCEyN 2013 33

Suma de Cuadrados

Tenemos quen∑

i=1(yi − yi)2 = ‖Y − PY‖2

Notemos que obtenemos el Teorema de Pitagoras. En efecto,

‖Y − ˆY‖2 = ‖Y − PY‖2 = ‖(I− P)Y‖2= Y′(I− P)′(I− P)Y= Y′(I− P)Y= Y′Y − Y′PY= Y′Y − Y′P′PY= ‖Y‖2 − ‖PY‖2

= ‖Y‖2 − ‖ˆY‖2 = ‖Y‖2 − ‖η‖2

Modelo Lineal A. M. Bianco FCEyN 2013 34

Caso en que rg(X) = p

Propiedades del Estimador de Mınimos Cuadrados

Usando la notacion matricial podemos escribir el modelo como

Ω : Y = Xβ + ε

E(ε) = 0

Σε = σ2I

Lema: Si se cumple el modelo Ω, tenemos que

ˆβ es un estimador insesgado de β, es decir E(ˆβ) = β.

Σˆβ= σ2(X′X)−1

Modelo Lineal A. M. Bianco FCEyN 2013 35

Caso en que rg(X) = p

Propiedades

Bajo el modelo Ω

Y = Xβ + ε

E(ε) = 0

Σε = σ2I

tenemos que

• E(ˆY) = Xβ• ΣY = σ2P• E(r) = 0• Σr = σ2(I− P)

Modelo Lineal A. M. Bianco FCEyN 2013 36

Si llamamos pi j a los elementos de P = X(X′X)−1X′ tenemos que

pi j = x′i(X′X)−1xj

donde xi representa la i–esima fila de X.

Luego:

V ar (yi) = σ2pi iV ar (ri) = σ2(1− pi i)

Cov(ri , rj) = −σ2pi j ,por lo tanto

Corr (ri , rj) = −pi j√

1− pi i√1− pj j

Modelo Lineal A. M. Bianco FCEyN 2013 37

Proposicion: Dados 1 ≤ i , j ≤ n tenemos que

i) 0 ≤ pi i ≤ 1ii) −12 ≤ pi j ≤ 12 si i 6= j

Como ya vimos V ar (yi) = σ2pi i , una consecuencia inmediata es que

V ar (yi) ≤ V ar (yi) = σ2 .

Modelo Lineal A. M. Bianco FCEyN 2013 38

Una propiedad interesante es que P es invariante por transformaciones linealesno singulares de la forma X → XA, donde A ∈ <p×p y rg(A) = p. Este tipode transformaciones es util, por ejemplo, si queremos realizar un cambio deunidades en las covariables.

Respecto a las propiedades de invariancia, podemos ver que si

ˆβ = ˆβ(X,Y) = (X′X)−1X′Y ,

para A ∈ <p×p no singular, λ ∈ < y γ ∈ <p, entoncesˆβ(XA,Y) = A−1ˆ

β Invariancia por transformaciones afinesˆβ(X, λY) = λˆ

β Invariancia por cambios de escalaˆβ(X,Y + Xγ) = ˆ

β + γ Invariancia por cambios de regresion

Modelo Lineal A. M. Bianco FCEyN 2013 39

Estimacion de σ2

Las varianzas de los estimadores dependen del diseno y σ2, que es desconocida.Dado que σ2 = E(ε2), parece natural estimarla mediante el promedio de loscuadrados de los residuos. El vector de residuos es

r = Y − ˆY

= Y − PY ,Bajo el modelo Ω, tenemos que

s2 =‖Y − ˆY‖2n − p =

‖Y − PY‖2n − p

es un estimador insesgado de σ2.

Lema Auxiliar: Sea x un vector aleatorio n–dimensional y sea A ∈ <n×n unamatriz simetrica. Si E(x) = µ y su matriz de covarianza es Σx entonces

E(x′Ax) = tr (AΣ) + µ′Aµ

Modelo Lineal A. M. Bianco FCEyN 2013 40

Respecto del diseno

• Covariables aleatoriasSi las covariables son aleatorias suponemos que tenemos los vectores (xi , yi)i.i.d. que satisfacen el modelo

yi = xiβ + εi

donde los εi son i.i.d., con E(εi) = 0 y V ar (εi) = σ2 e independientes dexi ∼ F .El analogo de suponer que X tiene rango completo es asumir que la distribucionde x no esta concentrada en ningun hiperplano, es decir

P (a′x = 0) < 1 ∀a 6= 0Esta condicion se cumple, por ejemplo, si x tiene densidad.

En este caso, ˆβ esta bien definido y las formulas que vimos para esperanza y

varianza de ˆβ son validas condicionalmente:

E(ˆβ|X = x) = β Σˆβ|X=x = σ

2(X′X)−1

Modelo Lineal A. M. Bianco FCEyN 2013 41

Se puede ver que si Vx = E(xx′) existe, entonces para n grande la distribucion

aproximada de ˆβ sera

Np

⎛⎜⎜⎝β,

σ2V−1xn

⎞⎟⎟⎠

Cuando el modelo tiene intercept, podemos escribirlo como:

yi = β0 + x′iβ1 + εi

donde β0 es la intercept y β1 es el vector de pendientes. En este caso resulta

σ2V−1x = σ2

⎛⎜⎜⎜⎜⎜⎜⎝

1 + µ′xΣ−1x µx −µ′xΣ−1x

−Σ−1x µx Σ−1x

⎞⎟⎟⎟⎟⎟⎟⎠

con µx = E(x) y Σx matriz de covarianza de x.

Modelo Lineal A. M. Bianco FCEyN 2013 42

• Estructura Ortogonal en la matriz de DisenoSupongamos que podemos dividir a la matriz X en k conjuntos de columnasortogonales: X1, . . . ,Xk , de manera que

X = [X1 . . .Xk ]

La correspondiente division en los parametros darıa

β = (β1, . . . ,βk)′

Luego podemos escribir:

E(Y) = X1β1 + . . .+ Xkβk

Como las columnas de Xi son ortogonales a las de Xj si i 6= j , tenemos queX′iXj = 0, luego

Modelo Lineal A. M. Bianco FCEyN 2013 43

ˆβ = (X′X)−1X′Y =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

X′1X1 0 . . . 00 X′2X2 . . . 0. . . . . . . . . . . .. . . . . . . . . X′kXk

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

−1 ⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

X′1YX′2Y. . .X′kY

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

entonces

ˆβ = (X′X)−1X′Y =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

(X′1X1)−1X′1Y

(X′2X2)−1X′2Y

. . .(X′kXk)

−1X′kY

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

=

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

ˆβ1ˆβ2. . .ˆβk

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

en consecuencia el estimador de βi no cambiara si alguno de los otros βj seiguala a 0, es decir si se remueve del modelo.

¿Como resulta la suma de cuadrados?

Modelo Lineal A. M. Bianco FCEyN 2013 44

Y′Y − ˆY′ˆY = Y′Y − ˆβ′X′Y = Y′Y − k∑

j=1

ˆβ′jX′jY

Por lo tanto si en el modelo ponemos algun βi = 0, el unico cambio en la sumade cuadrados es que el termino de ˆ

β′iX′iY no aparece:

Y′Y − k∑

j = 1

j 6= i

ˆβ′jX′jY

En el caso mas sencillo, cada Xi consta de una unica columna y resulta:

ˆβi =

X′iY

X′iXi

y la suma de cuadrados queda

Y′Y − k∑

j=1

ˆβ′jX′jY = Y

′Y − k∑

j = 1

ˆβ2jX′jXj

Modelo Lineal A. M. Bianco FCEyN 2013 45

Teorema de Gauss–Markov

En muchas aplicaciones estamos mas interesado en estimar funciones linealesde β que en estimar β en sı mismo.

Estas funciones incluyen el valor esperado de y en una futura observacion xo,por ejemplo.

Si bien puede haber muchos estimadores de una funcion lineal c′β o Cβ, estu-diaremos los estimadores lineales, es decir funciones lineales de las observacionesy1, . . . , yn.

Primero veremos cuando una funcion parametrica es estimable.

Definicion: Una funcion parametrica ψ se dice que es una funcion lineal delos parametros β1, . . . , βp si existen c1, . . . , cp constantes conocidas talque

ψ = c′β =p∑

j=1cjβj

donde c = (c1, . . . , cp)′.

Modelo Lineal A. M. Bianco FCEyN 2013 46

Definicion: Decimos que una funcion parametrica ψ = c′β es estimable sitiene un estimador lineal (en Y) insesgado, es decir si existe a ∈ <n tal que

E(a′Y) = ψ = c′β ∀β ∈ <p

¿Hay funciones que no son estimables?

Veamos un ejemplo de una funcion parametrica no estimable.

Modelo Lineal A. M. Bianco FCEyN 2013 47

Supongamos que queremos comparar la respuesta media de dos tratamientosy un control y que para ello observamos

T1: y11, y12, . . . , y1k y1j ∼ N(β1, σ2)

T2: y21, y22, . . . , y2k y2j ∼ N(β2, σ2)

Co: y31, y32, . . . , y3k y3j ∼ N(β3, σ2)

Suponemos igual cantidad de observaciones por tratamiento para simplificar lanotacion.

Podemos escribir esto como

yi j = βi + εi j

Podrıamos escribir esto como un modelo lineal:

Modelo Lineal A. M. Bianco FCEyN 2013 48

Y =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

y11y12. . .y1ky21y22. . .y2ky31y32. . .y3k

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

;X =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

1 0 01 0 0. . .1 0 00 1 00 1 0. . .0 1 00 0 10 0 1. . .0 0 1

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

;β =

⎛⎜⎜⎜⎜⎜⎜⎝

β1β2β3

⎞⎟⎟⎟⎟⎟⎟⎠

Por ejemplo, T1, T2 y el control podrıan ser distintas dosis de una droga demanera que T1 es menor que la dosis del control y T2 mayor que la dosis

Modelo Lineal A. M. Bianco FCEyN 2013 49

control. Tendrıa sentido preguntarse si

β3 =β1 + β22

lo que implicarıa cierta linealidad en el efecto medio. En ese caso nos interesarıasaber si

(−12,−12, 1

)

⎛⎜⎜⎜⎜⎜⎜⎝

β1β2β3

⎞⎟⎟⎟⎟⎟⎟⎠= 0

Otra manera de escribir el modeo serıa

yi j = µ+ αi + εi j

donde:

µ es el efecto general

αi es el efecto del tratamiento i

Modelo Lineal A. M. Bianco FCEyN 2013 50

En ese caso tendrıamos

Y =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

y11y12. . .y1ky21y22. . .y2ky31y32. . .y3k

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

;X =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

1 1 0 01 1 0 0. . . .1 1 0 01 0 1 01 0 1 0. . . .1 0 1 01 0 0 11 0 0 1. . . .1 0 0 1

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

;β =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

µα1α2α3

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

¿Son todas las funciones estimables en este modelo?

Modelo Lineal A. M. Bianco FCEyN 2013 51

Consideremos

α1 =(0, 1, 0, 0

)

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

µα1α2α3

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

Veremos que α1 no es estimable.

Veamos el siguiente resultado que caracteriza las funciones parametricas es-timables suponiendo el modelo

Ω : E(Y) = Xβ ΣY = σ2I

Teorema: La funcion parametrica ψ = c′β es estimable si y solo si c es unacombinacion lineal de las filas de X, o sea si existe a ∈ <n tal que

c′ = a′X

Modelo Lineal A. M. Bianco FCEyN 2013 52

Lema: Supongamos que vale el modelo Ω. Sean ψ = c′β una funcion es-timable y Vr el espacio generado por las columnas de X (r = rg(X) ≤ p).Luego, existe un unico estimador lineal insesgado de ψ, digamos a∗

′Y con

a∗ ∈ Vr . Mas aun, si a′Y es un estimador insesgado de ψ, a∗ es la proyeccionortogonal de a sobre Vr .

Teorema de Gauss–Markov:Supongamos que vale el modelo Ω : E(Y) = Xβ ΣY = σ

2I.Toda funcion estimable ψ = c′β tiene un unico estimador ˆ

ψ lineal insesgado demıınima varianza (BLUE). Este estimador ˆ

ψ se puede obtener reemplazando aβ en c′β por ˆ

β, el estimador de mınimos cuadrados.

Modelo Lineal A. M. Bianco FCEyN 2013 53

Definicion: Dada una funcion estimable ψ su unico estimador lineal insesgadode mınima varianza ˆ

ψ, cuya existencia y calculo estan dados por el Teorema deGauss–Markov, es el estimador de mınimos cuadrados de ψ.

Tenemos el siguiente resultado:

Corolario: Si ψ1, . . . , ψq son q funciones estimables toda combinacion linealΨ =

∑qi=1 hiψi es estimable y su estimador de mınimos cuadrado esta dado por

∑qi=1 hi

ˆψi .

Modelo Lineal A. M. Bianco FCEyN 2013 54

¿Que ocurre cuando el rg(X) < p

Si rg(X) = r < p tenemos que ˆβ1, . . . ,ˆβp no son unicos. Esta misma inde-

terminacion afecta a los parametros β1, . . . , βp, en el sentido de que distintosconjuntos b1, . . . , bp darıan origen al mismo η y por lo tanto al mismo modelo

Y = η + ε = E(Y) + ε .

Sin embargo, tal como vimos si c′β es una funcion estimable tendra el mismovalor independientente del β que usemos, en tanto

c′β = a′Xβ = a′η

expresion que solo depende de η, que es unico.

¿Como podemos eliminar esta indeterminacion?

Modelo Lineal A. M. Bianco FCEyN 2013 55

a) Considerar un problema reducido con solo r parametros

Podrıamos considerar r columnas l.i. de X que generen a Vr y mantener en elmodelo solo aquellos βj asociados a estas columnas.

Ası tendrıamos una nueva matriz de diseno X1 ∈ <n×r con rango maximo. Eneste caso tendrıamos el modelo

Y = η + ε con η ∈ VrEl estimador serıa

α = (X′1X1)−1X′1Y

y la matriz de proyeccion corresponiente P = X1(X′1X1)

−1X′1.

Si asumimos, s.p.g., que las columnas elegidas son las primeras r , tendrıamosque

X = [X1X2]

donde X2 ∈ <n×(p−r) y ademas X2 = X1B. Por lo tantoX = X1[Ir B] = KL

con K ∈ <n×r , L ∈ <r×p y rg(L) = r .

Modelo Lineal A. M. Bianco FCEyN 2013 56

Por lo tanto el modelo original se obtiene como:

Xβ = KLβ = Kα

b) Considerar condiciones de contorno adecuadas para los βj’s y susestimadores

Ası podrıamos pedir que βr+1 = . . . = βp = 0 y en este caso obtendrıamos elmismo que en la situacion a) (suponiendo que las r primeras son las columnasl.i.).

Sin embargo, en otras situaciones, como en la de ANOVA, es frecuente que seimpongan otras restricciones lineales de manera de obtener la unicidad.

Consideremos el caso en que imponemos t ≥ p − r restricciones lineales a losβj , es decir

Hβ = 0 con H ∈ <t×p

Queremos encontrar dentro del conjunto de soluciones de Xβ = η una sola

Modelo Lineal A. M. Bianco FCEyN 2013 57

que cumpla Hβ = 0, es decir buscamos β que sea unica solucion de

Xβ = Xβ (= η)

Hβ = 0

De esta forma las primeras ecuaciones establecen que encontraremos una solu-cion del sistema que nos interesa y las segundas que esta solucion sera unica.

Lo que queremos es que

• toda funcion estimable del nuevo sistema lo sea en el viejo problema,• un unico conjunto de estimadores de mınimos cuadrados que satisfaga lascondiciones de contorno.

El siguiente teorema nos dice como elegir H para cumplir con este objetivo:

Modelo Lineal A. M. Bianco FCEyN 2013 58

Teorema: Sean X ∈ <n×p y H ∈ <t×p con rg(X) = r , p > r y t ≥ p − r .Consideremos VX el espacio generado por las columnas de X. El sistema

Xb = z

Hb = 0 (1)

tiene solucion unica b para todo z ∈ VX si y solo si se cumplen las siguientesdos condiciones:

i) si rg(G) = rg

⎛⎜⎜⎝XH

⎞⎟⎟⎠ = p

ii) ninguna combinacion lineal de las filas de H es combinacion lineal de las deX, excepto el 0.

Corolario: Si el sistema (1) cumple la condiciones i) y ii) del Teorema ante-rior, entonces existe un unico conjunto de estimadores de mınimos cuadrados(solucion de las ecuaciones normales) β1, . . . , βp para el cual H

ˆβ = 0.

Modelo Lineal A. M. Bianco FCEyN 2013 59

Observacion:

En terminos estadısticos la condicion ii) del Teorema nos dice que si hi esla iesima fila de H, entonces no existe a tal que hi = a

′X, por lo tanto lash′iβ no es una funcion estimable de los parametros.

Se puede demostrar que:

Si se cumplen las condiciones i) y ii) del Teorema, entonces los βj sonfunciones estimables.

De hecho, si Gβ =

⎛⎜⎜⎝Xβ0

⎞⎟⎟⎠, entonces

G′Gβ = G′⎛⎜⎜⎝Xβ0

⎞⎟⎟⎠ = (X′ H′)

⎛⎜⎜⎝Xβ0

⎞⎟⎟⎠ = X′Xβ .

Luego, (X′X + H′H)β = X′Xβ y como rg(G′G) = rg(G) = p tenemosque

Modelo Lineal A. M. Bianco FCEyN 2013 60

β = (X′X+H′H)−1X′Xβ

y tiene un estimador lineal insesgado dado por

(X′X+H′H)−1X′Y

dada una funcion estimable ψ, para cualquier H que elijamos en las condi-ciones del Teorema anterior, V ar (ˆψ) es la misma.

c) Computar una inversa generalizada de X′X: (X′X)−

En este caso tendrıamos que (X′X)−XY es solucion de las ecuaciones normales,por lo tanto otra forma de solucionar nuestro problema. En realidad puede verseque la opcion b) y c) quedan ligadas a traves del siguiente resultado:

Proposicion: Sea G =

⎛⎜⎜⎝XH

⎞⎟⎟⎠ una matriz que satisface las condiciones i) y ii)

del Teorema anterior. Luego (G′G)−1 es una inversa generalizada de X′X, porlo tanto:

(X′X)(G′G)−1(X′X) = X′X

Modelo Lineal A. M. Bianco FCEyN 2013 61

En efecto, ∀Y:(G′G)(G′G)−1H′Y = H′Y

(X′X+H′H)(G′G)−1H′Y = H′Y

X′X(G′G)−1H′Y = H′(I−H(G′G)−1H′)Y

entonces como X′α = H′β tenemos que

X′X(G′G)−1H′Y = 0

luego

X(G′G)−1H′Y ∈ V⊥ry al mismo tiempo

X(G′G)−1H′Y ∈ Vrpor lo tanto

X(G′G)−1H′ = 0

Modelo Lineal A. M. Bianco FCEyN 2013 62

Finalmente:

(X′X)(G′G)−1(X′X) = (X′X+H′H)(G′G)−1(X′X) = X′X ,

con lo cual es una inversa generalizada.

Mınimos Cuadrados Pesados y Mınimos Cuadrados Generalizados

¿ Que ocurre cuando ΣY = σ2V donde V 6= I?

Supongamos que V ∈ <n×n es una matriz definida positiva de constantes.Podemos entonces escribir: V = KK′ con K una matriz invertible.

Y = Xβ + ε

K−1Y = K−1Xβ +K−1ε

Modelo Lineal A. M. Bianco FCEyN 2013 63

donde E(K−1ε) = 0 y ΣK−1ε = σ2I.

Por lo tanto, tenemos un nuevo problema:

Y = Xβ + ε

que satisface las condiciones de Ω.

Hallar el estimador de mınimos cuadrados en el problema transformado equivalea:

mınb‖Y − Xb‖2 = mın

b(Y − Xb)′(Y − Xb)

= mınb(Y − Xb)′K−1′K−1(Y − Xb)

= mınb(Y − Xb)′V−1(Y − Xb)

Si V es una matriz diagonal decimos que tenemos un problema de Mıni-mos Cuadrados Pesados, mientras que si V es una matriz definida positivacualquiera, es de Mınimos Cuadrados Generalizados.

Las ecuaciones normales quedan:

X′Xb = X′Y

Modelo Lineal A. M. Bianco FCEyN 2013 64

X′K−1′K−1Xb = X′K−1

′K−1Y

X′V−1Xb = X′V−1Y

Observemos que si X′V−1X tiene inversa, entonces

β = (X′V−1X)−1X′V−1Y

y ademas

β es un estimador insesgado de β, es decir E(β) = β.

Σ ˜β= σ2(X′X)

−1= σ2(X′V−1X)−1

Veamos un ejemplo.

Consideremos el caso sencillo de una regresion simple por el origen:

Y = xβ + ε

donde Y = (y1, . . . , yn)′, x = (x1, . . . , xn)′ y ε = (ε1, . . . , εn)′ con E(ε) = 0 y

Σε = σ2V = σ2diag(w1, . . . , wn) con wi > 0.

Modelo Lineal A. M. Bianco FCEyN 2013 65

Probaremos que

β =∑ni=1 yixi/wi

∑ni=1 x

2i /wi

y ademas

Σ ˜β= σ2(X′V−1X)−1 =

σ2

∑ni=1 x

2i /wi

Si rg(X) = p se puede probar facilmente que el estimador β conserva laspropiedades del estimador de mınimos cuadrados: dada una funcion lineal es-timable c′β tenemos que

• c′β es el estimador lineal insesgado de c′β de menor varianza.

Una pregunta muy natural es:

Modelo Lineal A. M. Bianco FCEyN 2013 66

¿ Hay situaciones en las que β y ˆβ coinciden?

Los siguientes resultados nos dan la respuesta

Teorema: Una condicion necesaria y suficiente para que β y ˆβ coincidan es

que VV−1X = VX.

Corolario: β y ˆβ coinciden ⇐⇒ VVX = VX.

Corolario: Si tenemos un modelo de regresion simple por el origen,Y = xβ + ε,entonces

β = ˆβ ∀x⇐⇒ V = cIn

Modelo Lineal A. M. Bianco FCEyN 2013 67

Forma Canonica del Modelo Ω

Dada una base ortonormal de Vr = VX, digamos α1, . . .αr , sabemos quepodemos extenderla a una base ortonormal de<n: α1, . . . ,αr ,αr+1, . . . ,αn.Por lo tanto,

y ∈ <n : y = n∑

j=1zjαj

y tenemos que

α′iy =n∑

j=1zjα

′iαj = ziα

′iαi = zi ∀i = 1, . . . , n

Luego, si definimos a T como la matriz que tiene filas α′i , entonces

z = Ty

Observemos que

E(zi) =

⎧⎨⎩

α′iη = ξi si 1 ≤ i ≤ r0 si r + 1 ≤ i ≤ n

Σz = TΣyT′ = σ2I

Modelo Lineal A. M. Bianco FCEyN 2013 68

Por lo tanto, ahora podemos reescribir a Ω como

Ω :

E(zi) =

⎧⎨⎩

ξi si 1 ≤ i ≤ r0 si r + 1 ≤ i ≤ n

Σz = σ2I

donde ξ y σ2 son parametros desconocidos.

En terminos de esta forma caonica es sencillo demostrar que

s2 =‖Y − ˆY‖2n − r ==

‖Y − η‖2n − r

es un estimador insesgado de σ2. Solo habıamos demostrado hasta ahora elcaso de rango completo.

Modelo Lineal A. M. Bianco FCEyN 2013 69

Distribucion Normal Multivariada

Definicion 1: Se dice que un vectorX, k−dimensional tiene distribucion normalmultivariada Nk(µ,Q) donde µ es un vector k−dimensional, Q una matriz dek × k definida positiva, si su densidad es de la forma

fX(x) =1

(√2π)k |Q|1/2 e

− (x−µ)′Q−1(x−µ)2

donde |Q| indica determinante de Q.

Por ejemplo, si Xi son k v.a. independientes tales que Xi ∼ N(µi , σ2i ), entoncesel vector X′ = (X1, . . . , Xk) tiene densidad

fx(x) =1

(√2π)k

∏kj=1(σ

2i )1/2

e−1/2Σki=1(xi−µi)2/σ2i

Luego, resulta que X es Nk(µ,Q) donde µ′ = (µ1, . . . , µk) y

Q = diag(σ21, . . . , σ2k) =

⎛⎜⎜⎜⎜⎜⎜⎝

σ21. . .

σ2k

⎞⎟⎟⎟⎟⎟⎟⎠

Modelo Lineal A. M. Bianco FCEyN 2013 70

Mas aun, en el caso en que las k v.a. Xi son todas N(0, 1), X es N(0k, Ik)donde 0′k = (0, . . . , 0) ∈ <k y Ik es la matriz identidad de k × k .Recordemos el enunciado del Teorema de Cambio de Variable:

Sean x es un vector aleatorio con densidad f y y = g(x), tal que g−1(y) = x.

Supongamos que en un abierto G existen las derivadas parciales ∂xi∂yjy sea

J = det

⎧⎨⎩

∂xi∂yj

⎫⎬⎭, entonces

fY(y) = fX(g−1(y))|J|

Teorema N1: Si X es un vector aleatorio k−dimensional con distribucionNk(µ,Q), A es una matriz no singular de k × k y b un vector k−dimensional,entonces

Y = AX+ b es Nk(Aµ+ b, AQA′)

Modelo Lineal A. M. Bianco FCEyN 2013 71

Teorema N2:

i) Un vector aleatorio k−dimensional X es Nk(µ,Q) si y solo si X = BY+µ,donde Y es Nk(0k, Ik) y B es una matriz de k×k no singular tal que BB′ = Q.

ii) Si X es Nk(µ,Q) entonces

E(X) = µ y ΣX = Q

Teorema N3: Sea X un vector aleatorio k−dimensional Nk(µ,Q) y A unamatriz de h × k con rango h, luego si Y = AX+ b entonces

Y ∼ Nh(Aµ+ b,AQA′)

Modelo Lineal A. M. Bianco FCEyN 2013 72

Teorema N4: Sea X′ = (X1, . . . , Xk) un vector k−dimensional con distribu-cion normal multivariada, luego la distribucion marginal de cualquier subconjun-to de componentes tiene distribucion normal multivariada. En particular cadacomponente es normal.

Demostracion: Sea X∗ = (Xk1, . . . , Xkh), k1 < k2 < . . . < kh, luego se tieneque X∗ = AX, donde A es la matriz de h × k dada por:

ai j =

⎧⎨⎩

1 si j = ki0 si j 6= ki

1 ≤ i ≤ h, 1 ≤ j ≤ k .Es facil ver que A es una matriz de rango h.

Modelo Lineal A. M. Bianco FCEyN 2013 73

Teorema N5: Si X es un vector k−dimensional con distribucion Nk(µ,Q),luego

(X− µ)′Q−1(X− µ) ∼ χ2k.

Demostracion: Por lo ya visto, resulta que X = BY+µ donde Y es N(0k, Ik)

Y = B−1(X− µ)y ademas

BB′ = Q

Luego

YY′ = (X− µ)′B′−1B−1(X− µ) = (X− µ)′Q−1(X− µ)El teorema resulta del hecho que

Y′Y =k∑

i=1Y 2i

tiene distribucion χ2k , ya que las Yi son variables aleatorias independientes condistribucion N(0, 1).

Modelo Lineal A. M. Bianco FCEyN 2013 74

Teorema N6: Si X es un vector k−dimensional con distribucion Nk(µ, σ2Ik)y P una matriz simetrica e idempotente de rango r , entonces

(X− µ)′P(X− µ)σ2

∼ χ2r.

Modelo Lineal A. M. Bianco FCEyN 2013 75

Tests y Regiones de Confianza

Hasta ahora hemos trabajado solo con las hipotesis Ω. Sin embargo para deducirtests y regiones de confianza con nivel exacto sera necesario que hagamos unsupuesto adicional: normalidad conjunta de los errores

Supondremos que las yi ’s se distribuyen conjuntamente segun unanormal multivariada.

Podremos deducir:

intervalos de confianza de nivel exacto para funciones parametricas es-timables

tests de nivel exacto para hipotesis que involucran a los parametros

conjuntos o regiones de confianza para la estimacion simultanea de mas deuna funcion parametrica estimable.

Modelo Lineal A. M. Bianco FCEyN 2013 76

Nuestro nuevo modelo sera:

Ω : Y ∼ Nn(Xβ, σ2I) rg(X) = r β ∈ <p

Observemos que en este caso suponer que ΣY = σ2I es equivalente a asumir

que las yi , 1 ≤ i ≤ n, son independientes.

Modelo Lineal A. M. Bianco FCEyN 2013 77

Modelo Lineal A. M. Bianco FCEyN 2013 78

Bajo estas condiciones se obtiene el siguiente resultado:

Teorema: Supongamos que se tiene el modelo

Ω : Y ∼ Nn(Xβ, σ2I) rg(X) = p β ∈ <p .Luego, ˆ

β y s2 son funciones de estadısticos suficientes y completos y por lotanto, ˆ

β y s2 son estimadores IMVU de β y σ2, respectivamente.

Si nuestro modelo es

E(Y) = β0 + β1x1 + β2x2 + . . .+ βpxp

podrıamos tener interes en testear hipotesis como las que siguen:

Ho : βj = 0 vs. H1 : βj 6= 0Ho : β1 − β2 = 0 vs. H1 : β1 − β2 6= 0

Ho : β1 = β2 = . . . = βp = 0 vs. H1 : existe j : βj 6= 0

Todas estas hipotesis son de la forma c′β = 0 o Cβ = 0.

Modelo Lineal A. M. Bianco FCEyN 2013 79

Supongamos que tenemos q funciones estimables ψ1, ψ2, . . . , ψq donde:

ψi =p∑

j=1ci jβj 1 ≤ i ≤ q

Por ser estimables, por el Teorema de Gauss–Markov tenemos que

ˆψi =

n∑

j=1a∗i jyj 1 ≤ i ≤ q ,

donde a∗i ∈ Vr ⊂ <n; de manera queΨ = Cβ C ∈ <q×pˆΨ = A∗Y A∗ ∈ <q×n

Mas aun, sabemos que

ˆΨ = Cˆβ

ΣΨ = σ2A∗A∗′

Modelo Lineal A. M. Bianco FCEyN 2013 80

Estimamos a σ2 por

s2=‖Y − ˆY‖2n − r

Bajo estas nuevas hipotesis obtenemos el siguiente resultado:

Teorema: Supongamos que se cumple Ω, es decir Y ∼ Nn(Xβ, σ2I), rg(X) =r , β ∈ <p y que ademas que ψ1, ψ2, . . . , ψq son q funciones estimables l.i.,de manera que rg(C) = q. Entonces,

i) ˆΨ ∼ Nq(Ψ,ΣΨ) ( o lo que es igual Nq(Ψ, σ2A∗A∗′))

ii) ˆΨ ys2(n − r )

σ2son independientes

iii)(n − r )s2

σ2∼ χ2n−r

Modelo Lineal A. M. Bianco FCEyN 2013 81

En el caso de rango completo, es decir cuando r = p, obtenemos el siguienteresultado:

Teorema: Supongamos que se cumple Ω, es decir Y ∼ Nn(Xβ, σ2I), rg(X) =p, β ∈ <p. Entonces,

i) ˆβ ∼ Np(β, σ2(X′X)−1)

ii)(ˆβ − β)′(X′X)(ˆβ − β)

σ2∼ χ2p

iii) ˆβ y(n − p)s2

σ2son independientes

iv)(n − p)s2

σ2∼ χ2n−p

Estos resultados nos permiten deducir intervalos de confianza o tests para cadauno de los coeficientes del modelo lineal:

Modelo Lineal A. M. Bianco FCEyN 2013 82

Como ˆβ ∼ Np(β, σ

2(X′X)−1), entonces ˆβi = e

′iˆβ ∼ N(βi , σ

2e′i(X′X)−1ei).

Si denotamos Σˆβ= σ2D

ˆβi ∼ N(βi , σ2di i)

siendo di i el i -esimo elemento diagonal de D.

Si para un i fijo queremos testear

Ho : βi = 0 vs. H1 : βi 6= 0

tenemos que bajo Hoˆβi

s√di i∼ tn−p

Por lo tanto, rechazaremos Ho con nivel α si

∣∣∣∣∣∣∣∣

ˆβi

s√di i

∣∣∣∣∣∣∣∣> tn−p,α2

Modelo Lineal A. M. Bianco FCEyN 2013 83

En el caso de regresion simple tendrıamos

yi = β0 + β1xi + εi , 1 ≤ i ≤ n, εi ∼ N(0, σ2)Entonces:

X′X =

⎛⎜⎜⎜⎜⎜⎜⎝

nn∑

i=1xi

n∑

i=1xi

n∑

i=1x2i

⎞⎟⎟⎟⎟⎟⎟⎠

y la inversa resulta

(X′X)−1 =1

n∑ni=1 x

2i − n2x2

⎛⎜⎜⎜⎜⎜⎜⎝

n∑

i=1x2i −

n∑

i=1xi

− n∑

i=1xi n

⎞⎟⎟⎟⎟⎟⎟⎠

Modelo Lineal A. M. Bianco FCEyN 2013 84

ˆβ0 = −x ˆ

β1 + y

y

ˆβ1 =

n∑

i=1xiyi − nx y

n∑

i=1x2i − nx2

=

n∑

i=1(xi − x)(yi − y)n∑

i=1(xi − x)2

Luego, si queremos testear

Ho : β1 = 0 vs. H1 : β1 6= 0el estadıstico sera

T =

∣∣∣∣∣∣∣∣

ˆβ1s√d11

∣∣∣∣∣∣∣∣=

∣∣∣∣∣∣∣∣

ˆβ1

s/√∑n

i=1(xi − x)2∣∣∣∣∣∣∣∣

y rechazaremos Ho si

|T | > tn−2,α2

Modelo Lineal A. M. Bianco FCEyN 2013 85

Veamos un ejemplo: Precio del papel.

Y: ganancia en 1972

x: precio de papel en 1973

¿ Ejemplo Precio del Papel

precio ganancia

x y

1 1.83 28

2 3.35 45

3 0.64 12

4 2.30 35

5 2.39 45

6 1.08 14

7 2.92 39

8 1.11 12

9 2.57 43

10 1.22 23

Modelo Lineal A. M. Bianco FCEyN 2013 86

1.0 1.5 2.0 2.5 3.0

1520

2530

3540

45

precio

gana

ncia

Modelo Lineal A. M. Bianco FCEyN 2013 87

¿ sal.lm

Coefficients:

(Intercept) x

2.027775 14.20517

Degrees of freedom: 10 total; 8 residual

Residual standard error: 5.025083

¿ summary(sal.lm)

Call: lm(formula = y ˜ x, x = T)

Residuals:

Min 1Q Median 3Q Max

-5.796 -4.222 0.1386 2.952 9.022

Modelo Lineal A. M. Bianco FCEyN 2013 88

Coefficients:

Value Std. Error t value Pr(¿—t—)

(Intercept) 2.0278 3.9383 0.5149 0.6206

x 14.2052 1.8565 7.6516 0.0001

Residual standard error: 5.025 on 8 degrees of freedom

Multiple R-Squared: 0.8798

F-statistic: 58.55 on 1 and 8 degrees of freedom, the p-value

is 0.00006008

Correlation of Coefficients:

(Intercept)

x -0.915

X’X=

(Intercept) x

(Intercept) 10.00 19.4100

x 19.41 45.0013

Modelo Lineal A. M. Bianco FCEyN 2013 89

(X’X)ˆ(-1)=

(Intercept) x

(Intercept) 0.6142273 -0.264929

x -0.2649290 0.136491

¿ matriz de covarianza de coeficientes

(Intercept) x

(Intercept) 15.510133 -6.689844

x -6.689844 3.446597

Modelo Lineal A. M. Bianco FCEyN 2013 90

Tambien podrıamos interesarnos realizar in I. de C. para la esperanza de unanueva observacion independiente de las demas que cumpla el modelo

yi = β1x1 + β1x2 + . . .+ βpxp + εi

en xo = (xo1, xo2, . . . , xop)′ donde εi ∼ N(0, σ2) independientes.

Como E(yo) = x′oβ, podemos estimarlo por

ˆE(yo) = x

′o

ˆβ = yo

Por lo tanto, de acuerdo con lo que hemos visto

yo = x′o

ˆβ ∼ N(x′oβ, σ2x′o(X′X)−1xo)

y es independiente de(n − p)s2

σ2∼ χ2n−p

por lo tanto

T =yo − x′oβ

s√x′o(X

′X)−1xo∼ tn−p

Modelo Lineal A. M. Bianco FCEyN 2013 91

En consecuencia,

yo ± tn−p,α2 s√x′o(X

′X)−1xo

es un intervalo de nivel exacto 1− α.

Asimismo, podrıamos estar interesados en la prediccion de yo, una nueva ob-servacion que cumpla el modelo, y en un intervalo para ella, que llamaremosintervalo de prediccion.

Observemos que el predictor de yo es yo = x′o

ˆβ. En efecto,

E(yo − yo) = 0. ¿Que distribucion tiene yo − yo?Tenemos que

yo ∼ N(x′oβ, σ2x′o(X

′X)−1xo)

yo ∼ N(x′oβ, σ2)

Modelo Lineal A. M. Bianco FCEyN 2013 92

y dado que yo es independiente de las restantes yi ’s con las que estimamos,entonces por la independencia entre estas dos normales queda que

yo − yo ∼ N(0, σ2(1 + x′o(X′X)−1xo))

Por lo tanto, el intervalo de prediccion de nivel 1− α estara dado poryo ± tn−p,α2 s

√1 + x′o(X

′X)−1xo

Modelo Lineal A. M. Bianco FCEyN 2013 93

Ejemplo. Los siguientes son datos que corresponden a 10 porcentajes yi de

una sustancia que fueron medidos en experiencias de laboratorio y que se deseanrelacionar con la temperatura xi a la que fueron realizados dichas experiencias.

i x y

1 100 452 110 523 120 544 130 635 140 626 150 687 160 758 170 769 180 9210 190 88

Modelo Lineal A. M. Bianco FCEyN 2013 94

La tabla con los estadısticos calculados es:

Coeficiente Estimacion Error Standard Valor de t

β0 -4.47273 5.63433 -0.79β1 0.49636 0.03812 13.02

s 3.46213 g.l.=8

Modelo Lineal A. M. Bianco FCEyN 2013 95

Intervalos de Estimacion y de Prediccion

Modelo Lineal A. M. Bianco FCEyN 2013 96

Tabla de Resultados

Modelo Lineal A. M. Bianco FCEyN 2013 97

• El valor estimado de ˆβ1 ' 0,5,⇒ esperamos que el porcentaje aumente 0.5

por cada incremento de un grado en la temperatura.

• sβ1 = 0,03812

• Si testeamos H0 : β1 = 0 t = 0,496360,038112 = 13,02 y t8,0,025 = 2,306004

⇒ los datos nos dan evidencia suficiente al nivel 5% como para concluir quela pendiente es no nula.

Modelo Lineal A. M. Bianco FCEyN 2013 98

Observemos que en el grafico la recta ajustada esta encerrada entre 2 curvasinteriores y 2 exteriores. Las exteriores corresponden al intervalo de prediccionde nivel 0.95 y las interiores a los intervalos de confianza de nivel 0.95 para lamedia.

Notemos que el nivel de confianza 0.95 se aplica a cada punto y no esglobal

Modelo Lineal A. M. Bianco FCEyN 2013 99

Supongamos que queremos plantear un test de nivel α para

Ho : Cβ = δ vs. H1 : Cβ 6= δ

siendo rg(C) = q , C ∈ <q×p.Sea Ψ = C′β. Sabemos que ˆΨ ∼ Nq(Ψ, σ

2A∗A∗′) = Nq(Ψ, σ

2B). Por lotanto, tenemos que

(1) : Q =1

q(ˆΨ− δ)′B−1(ˆΨ− δ)

es independiente de

(2) : s2 =‖Y − ˆY‖2n − r

Veremos queE(Q) = σ2 + η2

y que η2 = 0 solo cuando Ho es cierta.

Modelo Lineal A. M. Bianco FCEyN 2013 100

Bajo Ho, (1) y (2) son estimadores insesgados de σ2, es decir que bajo Ho

esperamos que(1)

(2)' 1,

pero si Ho no es cierta, esperamos que

(1)

(2)> 1.

Luego, el cociente(ˆΨ− δ)′B−1(ˆΨ− δ)

qs2nos dara una idea de la veracidad de

HO, de manera que rechazaremos Ho si el cociente es grande.

¿ Cuan grande?

Modelo Lineal A. M. Bianco FCEyN 2013 101

Bajo Ho(ˆΨ− δ)′B−1(ˆΨ− δ)

σ2∼ χ2q

independiente de(n − r )s2

σ2∼ χ2n−r

En consecuencia:

F =(ˆΨ− δ)′B−1(ˆΨ− δ)

qs2∼ Fq,n−r

Rechazaremos Ho si

F > Fq,n−r,αVeamos dos situaciones frecuentes para el caso de rango completo.

Modelo Lineal A. M. Bianco FCEyN 2013 102

1. Una hipotesis simple.

C = c consiste en una sola fila, de manera que c′(X′X)−1c es un escalar, conlo cual el estadıstico resulta

F =(c′ˆβ − δ)2s2 c′(X′X)−1c

que bajo Ho tiene distribucion F1,n−p

En funcion de la relacion entre las distribuciones t y F podrıamos utilizar ladistribucion t de Student y

rechazamos Ho si

∣∣∣∣∣∣∣∣

c ′ˆβ − δs

√c′(X′X)−1c

∣∣∣∣∣∣∣∣> tn−p,α/2

Modelo Lineal A. M. Bianco FCEyN 2013 103

2. Tests para k coeficientes iguales a 0.

Ho : Ψ = Cβ = 0, donde C =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

ei1··eik

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

, para i1 ≤ 1 < . . . < ik ≤ p.

El numerador sera:(Cˆβ)′(C(X′X)−1C′)−1(Cˆ

β)

donde C(X′X)−1C′ es una submatriz de D = (X′X)−1 que solo involucra loscoeficientes correspondientes a aquellos βi presentes en la hipotesis a testear.

Ası supongamos que tenemos 5 coeficientes β1, . . . , β5 y queremos testear

Ho : β1 = 0

β3 = 0

β5 = 0

Modelo Lineal A. M. Bianco FCEyN 2013 104

luego,

C(X′X)−1C′ =

⎛⎜⎜⎜⎜⎜⎜⎝

d11 d13 d15d13 d33 d35d15 d35 d55

⎞⎟⎟⎟⎟⎟⎟⎠

y en el numerador tendremos

( ˆβ1,

ˆβ3,

ˆβ5

)

⎛⎜⎜⎜⎜⎜⎜⎝

d11 d13 d15d13 d33 d35d15 d35 d55

⎞⎟⎟⎟⎟⎟⎟⎠

−1 ⎛⎜⎜⎜⎜⎜⎜⎝

ˆβ1ˆβ3ˆβ5

⎞⎟⎟⎟⎟⎟⎟⎠

Modelo Lineal A. M. Bianco FCEyN 2013 105

Test de Cociente de Verosimilitud

El test de F tambien puede motivarse como test de cociente de verosimilitud.

Sea Ω el conjunto de supuestos generales y supongamos que bajo este modelotesteamos la hipotesis H, llamemos ω = Ω ∩H. Ası, por ejemplo, si

Ω : Y ∼ Nn(Xβ, σ2I) β = (β0, β1, . . . , βp−1)′

yH : β1 = . . . = βp−1 = 0

entonces ω = Ω ∩H equivale aY ∼ Nn(β0, σ2I) .

Si p(y) es la funcion de densidad o de probabilidad de Y definimos λ el es-tadıstico del cociente de verosimilitud como

λ =maxω p(y)

maxΩ p(y)

Notemos que 0 ≤ λ ≤ 1 ya que ω ∈ Ω y por lo tanto maxω p(y) ≤ maxΩ p(y).

Modelo Lineal A. M. Bianco FCEyN 2013 106

H sera rechazada cuando maxω p(y) es mucho mas chico que maxΩ p(y), porlo tanto rechazaremos H si λ < λα.

Existen dos formas equivalentes de plantear las hipotesis:

• 1)Ω : Y ∼ Nn(Xβ, σ2I) rg = rH : Ψ1 = Ψ2 = . . . = Ψq = 0

donde Ψi son l.i. funciones estimables• 2)

Ω : Y ∼ Nn(η, σ2I) η ∈ VrH : η ∈ Vr−q

donde Vr es un subespacio de dimension r en <n y Vr−q es un subespaciode dimension r − q en Vr .

Vr es el espacio generado por las columnas de X y Vr−q es el espacio al cual

Modelo Lineal A. M. Bianco FCEyN 2013 107

esta restringido η a yacer al imponerle las restricciones Ψ1 = Ψ2 = . . . =Ψq = 0.

Las dos formas son equivalentes, nosotros probaremos que • 1) =⇒ • 2).Tenemos que Y ∼ Nn(η, σ

2I) η ∈ Vr . Llamemos C a la matriz tal queΨ = Cβ. Luego:

Vω = v = Xβ tal que Cβ = 0 = v = Xβ tal que A∗Xβ = 0= v = Xβ tal que A∗v = 0

A∗ =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

a∗1...a∗q

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

. Es decir, v ⊥ a∗i 1 ≤ i ≤ q.

Como rg = q entonces a∗1, . . . , a∗q son l.i. Por lo tanto, v ∈ V⊥<a∗1...a∗q> :

complemento ortogonal de V<a∗1...a∗q> en Vr .

Modelo Lineal A. M. Bianco FCEyN 2013 108

Ademas, tenemos que

r = dim(V<a∗1...a∗q>) + dim(V⊥<a∗1...a∗q>

)

por lo tanto,dim(V⊥<a∗1...a∗q>) = dim(Vω) = r − q

Calculemos λ. Para ello deberemos calcular el maximo de de p(y) en c/u delos subespacios.

Veremos que λ =⎛⎝ ‖y−η‖2‖y−ηω‖2

⎞⎠n/2

y por lo tanto rechazamos H0 si

λ =

⎛⎜⎜⎝‖y − η‖2‖y − ηω‖2

⎞⎟⎟⎠

n/2

< kα

Si aplicamos a este cociente la funcion g(t) = n−rq

(t−2/n − 1

), resulta

F =n − rq

‖y − ηω‖2 − ‖y − η‖2‖y − η‖2

=1

q

‖y − ηω‖2 − ‖y − η‖2s2

Modelo Lineal A. M. Bianco FCEyN 2013 109

Como veremos

F =1

q

‖ηω − η‖2s2

Luego, rechazaremos H si

1

q

‖ηω − η‖2s2

> λα

Una interpretacion intuitiva para este test es que ‖y− ηω‖2 y ‖y− η‖2 midencuan bien ajustan los modelos ω y Ω, respectivamente. Por lo tanto, su cocientecompara el ajuste de ω con el de Ω y rechazamos H si este cociente es grande:

F > λα

¿ Que distribucion tiene el cociente F?

Tenemos que Vr−q ∈ Vr ∈ <n. Tomemos una base ortonormal de Vr−q :αq+1, . . .αr y la extendemos a una base ortonormal deVr : α1, . . . ,αq,αq+1, . . . ,αr y finalmente a una de <n:α1, . . . ,αr ,αr+1, . . . ,αn.

Modelo Lineal A. M. Bianco FCEyN 2013 110

α1, . . . ,αq,αq+1, . . . ,αr ,αr+1, . . . ,αn

Por lo tanto,

y ∈ <n : y = n∑

j=1zjαj

y tenemos que

α′iy =n∑

j=1zjα

′iαj = ziα

′iαi = zi ∀i = 1, . . . , n

Luego, si definimos a T como la matriz que tiene filas α′i , entonces

z = Ty

Observemos que bajo el modelo Ω

E(zi) =

⎧⎨⎩

α′iη = ξi si 1 ≤ i ≤ r0 si r + 1 ≤ i ≤ n

Σz = TΣyT′ = σ2I

Modelo Lineal A. M. Bianco FCEyN 2013 111

Bajo el modelo ω, tenemos que η = E(Y) ∈ Vr−q, es decir α′iη = 0 parai = 1, . . . , q.

E(zi) =

⎧⎨⎩

0 si 1 ≤ i ≤ qξi si q + 1 ≤ i ≤ r0 si r + 1 ≤ i ≤ n

Entonces podemos escribir:

Ω : z ∼ Nn(ξ, σ2I) ξi = 0 i ≥ r + 1ω : z ∼ Nn(ξ, σ2I) ξi = 0 1 ≤ i ≤ q y i ≥ r + 1

Utilizando la notacion de Scheffe tendremos

SΩ = ‖y − η‖2 =n∑

i=r+1z2i

Sω = ‖y − ηω‖2 =q∑

i=1z2i +

n∑

i=r+1z2i

y ademas

Sω − SΩ =q∑

i=1z2i

Modelo Lineal A. M. Bianco FCEyN 2013 112

‖y − ηω‖2 − ‖y − η‖2 = ‖η − ηω‖2 =q∑

i=1z2i

Ademas, bajo H tenemos que Sω−SΩσ2∼ χq independiente de s

2 y en conse-cuencia

1

q

Sω − SΩs2

∼ Fq,n−r

Rechazamos H si1

q

Sω − SΩs2

> Fq,n−r,α

Observacion: Puede demostrarse que este test es equivalente al tests de Fya visto.

Modelo Lineal A. M. Bianco FCEyN 2013 113

Modelo Lineal A. M. Bianco FCEyN 2013 114

Ejemplo:

Significacion de la Regresion. Tabla de Analisis de la Varianza

Supongamos que tenemos el modelo con intercept dado por

E(Y) = β0 + β1x1 + β2x2 + . . .+ βp−1xp−1

y queremos testear

Ho : β1 = β2 = . . . = βp−1 = 0

de manera que ω = Ω ∩ H. H impone p − 1 restricciones l.i. Trataremos elcaso en que rg(X) = p

¿Quien es Vω?dim(Vω) = r − (p − 1) = p − (p − 1) = 1 y tenemos que V1 ∈ Vp¿Quien es ηω?

Bajo ω, β1 = . . . = βp−1 = 0, E(Y) = β0.

Tenemos que:

Modelo Lineal A. M. Bianco FCEyN 2013 115

Xω =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

11..1

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

→ ˆβ0 = (X

′ωXω)

−1X′ωY =1

n

n∑

i=1yi = Y.

Luego: ηω = X′ωˆβ0 =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

YY..Y

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

Ademas:‖Y‖2 = ‖Y − η‖2 + ‖η − ηω‖2 + ‖ηω‖2

Bajo Ω si rg(X) = p

ˆβΩ = (X

′X)−1X′Y → η = PY donde P = X(X′X)−1X′

Modelo Lineal A. M. Bianco FCEyN 2013 116

En efecto, ηω es la proyeccion ortogonal de η sobre Vω = V1. Si fuera ası,entonce η − ηω ⊥ ηω.

η = PY y ηω = 1(1′1)−11′Y = P1Y

luego,

(η−ηω)′ηω = Y′(P−Pω)PωY = Y′(PPω−P′ωPω)Y = Y′(Pω−Pω)′PωY = 0

Modelo Lineal A. M. Bianco FCEyN 2013 117

‖Y‖2 = ‖Y − η‖2 + ‖η − ηω‖2 + ‖ηω‖2Llamaremos

‖Y‖2: suma de cuadrados total‖Y − η‖2: suma de cuadrados residual‖η − ηω‖2: suma de cuadrados de la regresion‖Y − ηω‖2: suma de cuadrados total corregida

Tenemos las siguientes igualdades

‖Y‖2 = Y′Y g.l=n

‖Y − η‖2 = Y′Y − ˆβ′XY g.l=n − p

‖η − ηω‖2 = ˆβ′XY − n(Y)2 g.l=p − 1

‖Y − ηω‖2 = Y′Y − n(Y)2 g.l=n − 1

Modelo Lineal A. M. Bianco FCEyN 2013 118

Si quisieramos verificar la significacion de la regresion, harıamos

F =‖η − ηω‖2/p − 1‖Y − η‖2/n − p

Muchos programas ofrecen en su salida una tabla como la que sigue

Fuente g.l. M.S. F p-valor

Regresion ‖η‖2 − n(Y)2 p − 1 (1) = ‖η‖2−n(Y)2p−1

Residual ‖Y − η‖2 n − p (2) = ‖Y−η‖2n−p (1)/(2)

Tot. Cor. ‖Y‖2 − n(Y)2 n − 1Cuadro 1: Tabla de ANOVA

Modelo Lineal A. M. Bianco FCEyN 2013 119

Datos de Biomasa

Produccion de biomasa en el estuario de Cape Fear: los datos corresponden aun estudio de la Universidad de North Carolina en el que se muestrearon 3 tiposde vegetacion en tres localidades. En cada una se muestreo al azar 5 lugarescon un total de 45 observaciones. Analizaremos las variables del sustrato:

x1=SAL: Salinidad

x2=pH: Acidez

x3= K: Potasio

x4=Naa: Sodio

x5=Zn: Zinc

y : Biomasa Aerea

En esta etapa nos concentraremos en identificar aquellas variables que muestranmayor relacion con y . Ajustaremos el modelo

E(y) = β0 + β1SAL+ β2pH + β3K + β4Naa + β5Zn

Modelo Lineal A. M. Bianco FCEyN 2013 120

SALIDA DE S-PLUS

DATOS DE BIOMASA

¿ sal.lm

Call:

lm(formula = BIO ˜ ., data = bio)

Coefficients:

(Intercept) K NAA PH SAL ZN

1252.589 -0.2853166 -0.008662343 305.4821 -30.28808 -20.67844

Degrees of freedom: 45 total; 39 residual

Residual standard error: 398.2671

¿ summary(sal.lm)

Call: lm(formula = BIO ˜ ., data = bio)

Residuals:

Min 1Q Median 3Q Max

-748.1 -223.7 -85.22 139.1 1072

Modelo Lineal A. M. Bianco FCEyN 2013 121

Coefficients:

Value Std. Error t value Pr(¿—t—)

(Intercept) 1252.5895 1234.7294 1.0145 0.3166

K -0.2853 0.3483 -0.8191 0.4177

NAA -0.0087 0.0159 -0.5438 0.5897

PH 305.4821 87.8831 3.4760 0.0013

SAL -30.2881 24.0298 -1.2604 0.2150

ZN -20.6784 15.0544 -1.3736 0.1774

Residual standard error: 398.3 on 39 degrees of freedom

Multiple R-Squared: 0.6773

F-statistic: 16.37 on 5 and 39 degrees of freedom, the p-value is 1.082e-008

Correlation of Coefficients:

(Intercept) K NAA PH SAL

K -0.3122

NAA 0.3767 -0.8103

PH -0.8406 0.1212 -0.2442

SAL -0.9180 0.3047 -0.4324 0.6045

ZN -0.8809 0.1908 -0.3386 0.8350 0.7113

Modelo Lineal A. M. Bianco FCEyN 2013 122

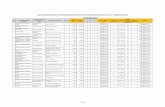

SALIDA DE SX

PREDICTOR

VARIABLES COEFFICIENT STD ERROR STUDENT’S T P VIF

--------- ----------- --------- ----------- ------ -----

CONSTANT 1252.59 1234.73 1.01 0.3166

K -0.28532 0.34832 -0.82 0.4177 3.0

NAA -0.00866 0.01593 -0.54 0.5897 3.3

PH 305.482 87.8831 3.48 0.0013 3.3

SAL -30.2881 24.0298 -1.26 0.2150 2.2

ZN -20.6784 15.0544 -1.37 0.1774 4.3

R-SQUARED 0.6773 RESID. MEAN SQUARE (MSE) 158617

ADJUSTED R-SQUARED 0.6360 STANDARD DEVIATION 398.267

SOURCE DF SS MS F P

---------- --- ---------- ---------- ----- ------

REGRESSION 5 1.298E+07 2596983 16.37 0.0000

RESIDUAL 39 6186050 158617

TOTAL 44 1.917E+07

CASES INCLUDED 45 MISSING CASES 0

Modelo Lineal A. M. Bianco FCEyN 2013 123

Hipotesis Anidadas

La interpretacion del test de F en terminos de las hipotesis anidadas.

Supongamos que tenemos H1, H2, . . . , Hk un conjunto de hipotesis que im-ponen q1, q2, . . . , qk restricciones independientes, respectivamente. Luego, lasq1+q2+. . .+qk funciones estimables son l.i. La secuencia de hipotesis anidadasestara dada por

Ω, ω1 = Ω ∩H1, ω2 = Ω ∩ H1 ∩H2, . . . , ωk = Ω ∩H1 ∩H2 . . . ∩HkSi lamamos V(j) a los espacios asociados cada uno de dimensionr − q1 − q2 − . . .− qj

V(r) ⊃ V(r−q1) ⊃ . . .V(r−q1−q2−...−qk)

Sea ηωj la proyeccion ortogonal de Y sobre V(j), por lo tanto tenemos que

Y = Y − η + η − ηω1 + ηω1 − ηω2 + . . .+ ηωk−1 − ηωk + ηωk

Modelo Lineal A. M. Bianco FCEyN 2013 124

y en consecuencia

‖Y ‖2 = ‖Y −η‖2+‖η−ηω1‖2+‖ηω1−ηω2‖2+. . .+‖ηωk−1−ηωk‖2+‖ηωk‖

2

donde cada suma tiene una distribucion χ2 no central bajo Ω con n−r, q1, q2, . . . , qk,r − q1 − q2 − . . .− qk grados de libertad.

Modelo Lineal A. M. Bianco FCEyN 2013 125

Intervalos Simultaneos y Regiones de Confianza

Metodo de Bonferroni

Queremos hallar intervalos de confianza para q combinaciones lineales de laforma c′iβ i = 1, 2, . . . , q.

Bajo normalidad, para cada combinacion lineal el intervalo de la forma

c′iˆβ ± tn−r,δ/2σc′i ˆβ

tiene nivel 1− δ.

Definamos los eventos

Ei : c′iβ pertenece al intervalo i

tenemos que P (Ei) = 1− δLuego,

1− α = P (todos los intervalos son correctos) = P (∩qi=1Ei)

Modelo Lineal A. M. Bianco FCEyN 2013 126

= 1− P ((∩qi=1Ei)c) = 1− P (∪qi=1Eci )≥ 1−

q∑

i=1P (Eci ) = 1− qδ

Ası, por ejemplo si cada intervalo tiene nivel 0.95 (δ = 0.05) y q = 10 ten-drıamos que

1− α ≥ 1− qδ = 1− 10 ∗ 0.05 = 0.50¿ Como podrıamos mejorar esto?

Si cada δ =α

q, entonces preservarıamos un nivel global superior a 1− α.

Una clara desventaja de este metodo es que si q es grande al exigir que cadaintervalo tenga nivel 1 − α

q , podemos obtener intervalos muy anchos y por lotanto, de escaso valor practico.

Modelo Lineal A. M. Bianco FCEyN 2013 127

Metodo de Scheffe

Supondremos s.p.g. que c1, c2, . . . , cq son l.i. Sea Ψ = Cβ, donde C ∈ IRq×p.Inicialmente supondremos que rg(X) = p. En este caso, sabemos que

(ˆΨ−Ψ)′(C(X′X)−1C′)−1(ˆΨ−Ψ)qs2

∼ Fq,n−pentonces

1− α = P (Fq,n−p ≤ Fq,n−p,α)

= P((ˆΨ−Ψ)′(C(X′X)−1C′)−1(ˆΨ−Ψ) ≤ qs2Fq,n−p,α

)

= P((ˆΨ−Ψ)′L−1(ˆΨ−Ψ) ≤ m

)

= P(b′L−1b ≤ m

)

Modelo Lineal A. M. Bianco FCEyN 2013 128

Recordemos que dada L una matriz definida positiva tenemos que

suph6=0

(h′b)2

h′Lh= b′L−1b

con lo cual, tenemos

1− α = P

⎛⎜⎜⎜⎝suph6=0

(h′b)2

h′Lh≤ m

⎞⎟⎟⎟⎠

= P

⎛⎜⎜⎜⎝(h′b)2

h′Lh≤ m ∀h 6= 0

⎞⎟⎟⎟⎠

= P

⎛⎜⎜⎝

∣∣∣∣h′ˆΨ− h′Ψ∣∣∣∣

s(h′Lh)1/2≤

√qFq,n−p,α ∀h 6= 0

⎞⎟⎟⎠

= P(∣∣∣∣h′ˆΨ− h′Ψ

∣∣∣∣ ≤√qFq,n−p,α s(h

′Lh)1/2 ∀h 6= 0)

Modelo Lineal A. M. Bianco FCEyN 2013 129

Luego, para cualquier funcion lineal h′Ψ tenemos el intervalo de confianza

h′ˆΨ±√qFq,n−p,α s(h

′Lh)1/2

siendo la probabilidad total de la clase 1− α.

Supongamos que r = p y C = Ip, en ese caso tendrıamos

(ˆβ − β)′(X′X)(ˆβ − β) ≤ ps2Fp,n−p,αque define lo que se conoce como el elipsoide de confianza.

Modelo Lineal A. M. Bianco FCEyN 2013 130

¿Como es en el caso general en el que rg(X) = r?

Tenemos que c′1β, c′2β, . . . , c

′qβ son l.i. Sea Ψ = Cβ, donde C ∈ IRq×p,

rg(C) = q.

Recordemos que(ˆΨ−Ψ)′B−1(ˆΨ−Ψ)

qs2∼ Fq,n−r

donde ˆΨ ∼ N(Ψ,ΣΨ),ΣΨ = σ2B = σ2A∗A∗′.

Como rg(C) = q, entonces B tiene inversa, por lo tanto

1− α = P ((ˆΨ −Ψ)′B−1(ˆΨ−Ψ) ≤ qs2Fq,n−r,α)= P ((ˆΨ −Ψ)′B−1(ˆΨ−Ψ) ≤ m)

= P (suph6=0

(h′b)2

h′Bh≤ m)

= P (

∣∣∣∣h′ˆΨ− h′Ψ∣∣∣∣

s(h′Bh)1/2≤

√qFq,n−r,α ∀h 6= 0)

Modelo Lineal A. M. Bianco FCEyN 2013 131

De esta forma,h′ˆΨ±

√qFq,n−r,α s(h

′Bh)1/2

resulta un intervalo de confianza para la funcion lineal h′Ψ y la probabilidadtotal de la clase es 1− α. Observemos que este intervalo es de la forma:

h′ˆΨ±√qFq,n−r,α σh′Ψ

Modelo Lineal A. M. Bianco FCEyN 2013 132

Volvamos al ejemplo de Biomasa

¿ cor(xx)

BIO K NAA PH SAL ZN

BIO 1.0000000 -0.20511626 -0.27206950 0.77418613 -0.10316780 -0.62440784

K -0.2051163 1.00000000 0.79213460 0.01869352 -0.02049881 0.07396686

NAA -0.2720695 0.79213460 1.00000000 -0.03771997 0.16226567 0.11704693

PH 0.7741861 0.01869352 -0.03771997 1.00000000 -0.05133280 -0.72216711

SAL -0.1031678 -0.02049881 0.16226567 -0.05133280 1.00000000 -0.42083353

ZN -0.6244078 0.07396686 0.11704693 -0.72216711 -0.42083353 1.00000000

Analisis con todas las variables: lm(formula = BIO ˜ K + NAA + PH + SAL + ZN)

Value Std. Error t value Pr(¿—t—)

(Intercept) 1252.5895 1234.7294 1.0145 0.3166

K -0.2853 0.3483 -0.8191 0.4177

NAA -0.0087 0.0159 -0.5438 0.5897

PH 305.4821 87.8831 3.4760 0.0013

SAL -30.2881 24.0298 -1.2604 0.2150

ZN -20.6784 15.0544 -1.3736 0.1774

Residual standard error: 398.3 on 39 degrees of freedom

Multiple R-Squared: 0.6773

F-statistic: 16.37 on 5 and 39 degrees of freedom, the p-value is 1.082e-008

Modelo Lineal A. M. Bianco FCEyN 2013 133

lm(formula = BIO ˜ K + PH + SAL + ZN)

Value Std. Error t value Pr(¿—t—)

(Intercept) 1505.4479 1133.6647 1.3279 0.1917

K -0.4388 0.2023 -2.1688 0.0361

PH 293.8169 84.4685 3.4784 0.0012

SAL -35.9374 21.4758 -1.6734 0.1021

ZN -23.4497 14.0396 -1.6703 0.1027

Residual standard error: 394.7 on 40 degrees of freedom

Multiple R-Squared: 0.6749

F-statistic: 20.76 on 4 and 40 degrees of freedom, the p-value is 2.525e-009

lm(formula = BIO ˜ K + PH + SAL)

Value Std. Error t value Pr(¿—t—)

(Intercept) -131.1184 582.5120 -0.2251 0.8230

K -0.4900 0.2043 -2.3985 0.0211

PH 410.1454 48.8253 8.4003 0.0000

SAL -12.0533 16.3687 -0.7364 0.4657

Residual standard error: 403.3 on 41 degrees of freedom

Multiple R-Squared: 0.6522

F-statistic: 25.63 on 3 and 41 degrees of freedom, the p-value is 1.682e-009

Modelo Lineal A. M. Bianco FCEyN 2013 134

lm(formula = BIO ˜ K + PH)

Value Std. Error t value Pr(¿—t—)

(Intercept) -506.7131 279.8016 -1.8110 0.0773

K -0.4871 0.2031 -2.3977 0.0210

PH 411.9779 48.4954 8.4952 0.0000

Residual standard error: 401.1 on 42 degrees of freedom

Multiple R-Squared: 0.6476

F-statistic: 38.59 on 2 and 42 degrees of freedom, the p-value is 3.074e-010

Los intervalos de confianza de nivel individual 95% obtenidos a partir del ultimomodelo ajustado serıan tal como vimos de la forma

ˆβi ± t42,0.025σβi siendo t42,0.025 = 2.018

En este caso resultan:

-1.072 < β0 < 58

314 < βPH < 510

-0.898 < βK < -0.077

Modelo Lineal A. M. Bianco FCEyN 2013 135

Si los calculamos con el metodo de Bonferroni como para que el nivel globalresulte 95% usarıamos t42,0.025/3 = 2.50 y estos resultan

-1.206 < β0 < 192

291 < βPH < 533

-0.995 < βK < 0.021

La region de confianza obtenida a partir de metodo de Scheffe serıa

Modelo Lineal A. M. Bianco FCEyN 2013 136

Modelo Lineal A. M. Bianco FCEyN 2013 137

Comparacion entre los metodos

Se puede ver que si las q combinaciones son l.i. entonces

tν, α2q <√qFq,ν,α

Por ejemplo, si α = 0,05, q = 5 y n = 26, entonces

√qFq,ν,α = 3,68 tν, α2q = 2,85

En general, si se quieren realizar intervalos simultaneos para k funciones parametri-cas de las cuales q son l.i.,para α = 0,05 se puede ver que si q ≤ k y k nomucho mas grande que q, entonces

tν, α2k <√qFq,ν,α

Cuando k es mucho mas grande que q, entonces la desigualdad se invierte.

Modelo Lineal A. M. Bianco FCEyN 2013 138

Relacion entre el tests de F y el metodo de Scheffe

Los intervalosh′ˆΨ±

√qFq,n−r,α s(hBh)

1/2 (∗)y el test de F para chequear H : Ψ = δ estan relacionados.

El test de F no es significativo al nivel α si y solo si

(ˆΨ− δ)′B−1(ˆΨ− δ)qs2

≤ Fq,n−r,α

que es cierto si y solo si Ψ = δ esta en la region (ˆΨ−Ψ)′B−1(ˆΨ−Ψ) ≤ m,o sea si y solo si h′δ esta contenido en (*).

Dicho de otra forma, F es significativo si uno o mas intervalos (*) no contienena h′δ, el problema es identificar cual de las combinaciones lineales es la que noesta contenida.

Modelo Lineal A. M. Bianco FCEyN 2013 139

Coeficiente de Correlacion Multiple ( o coeficiente de determinacion)

Supongamos que tenemos el modelo

yi = β0 + β1xi1 + β2xi2 + . . .+ βp−1xip−1 + εi

y nos interesa testear

H : β1 = . . . = βp−1 = 0

Consideremos Ω y ω = Ω ∩ H. Llamaremos η a la proyeccion de Y sobre elsubespacio asociado a Ω y ηω a la proyeccion sobre el subespacio asociado aω.

¿Cual es la correlacion muestral entre el vector de observaciones Y y el vectorde predichos ˆY (o η) ?

R =

n∑

i=1(yi − y)(yi − y)

n∑

i=1(yi − y)2

n∑

i=1(yi − y)21/2

Modelo Lineal A. M. Bianco FCEyN 2013 140

Recordemos que cuando hay ordenada al origen, tenemos que

∂

∂β0‖Y−Xβ‖2 = n∑

i=1(yi−(β0+β1xi1+β2xi2+. . .+βp−1xip−1) =

n∑

i=1(yi−yi)2 = 0

entoncesy = y

y en consecuencia

R =

n∑

i=1(yi − y)(yi − y)

n∑

i=1(yi − y)2

n∑

i=1(yi − y)21/2

Visto en terminos de proyecciones y productos internos, tendrıamos

R =〈Y − ηω, η − ηω〉‖Y − ηω‖‖η − ηω‖

Como

〈Y − ηω, η − ηω〉 = 〈Y − η, η − ηω〉+ 〈η − ηω, η − ηω〉= ‖η − ηω‖2

Modelo Lineal A. M. Bianco FCEyN 2013 141

obtenemos que

R2 =‖η − ηω‖2‖Y − ηω‖2

=Suma Cuadrados Total Regresion

Suma Cuadrados Total Corregida

es decir

R2 =

n∑

i=1(yi − y)2

n∑

i=1(yi − y)2

La relacion entre el estadıstico F y el coeficiente de correlacion multiple esta da-da por el siguiente resultado

Modelo Lineal A. M. Bianco FCEyN 2013 142

Teorema: Supongamos que deseamos testear H : Cβ = 0, que no involucraal intercept β0, es decir C es de la forma [0,C1]. Consideremos ω1 = Ω ∩ H.Sea

R2ω1 =

n∑

i=1(yiω1 − y)2n∑

i=1(yi − y)2

entonces el estadıstico F para testear H sera

F =(R2 − R2ω1)(n − p)(1− R2)q

Como corolario de este teorema obtenemos que R2 − R2ω1 ≥ 0 pues F ≥ 0 ypor lo tanto, el coeficiente de correlacion multiple o de determinacion R2 nuncadecrece al agregar una variable regresora extra.

Esta es una deventaja de R2 si uno lo quiere usar para comparar el ajuste demodelos de distinto numero de covariables, y por esta razon se suele utilizar elcoeficiente de determinacion ajustado definido por

Modelo Lineal A. M. Bianco FCEyN 2013 143

R2adj = 1− (1− R2)n

n − pque no crece necesariamente con p y de hecho se puede demostrar que R2adjaumenta al agregar una covariable solo si el estadıstico F que testea que losparametros agregados son 0 es mayor a 1.

Modelo Lineal A. M. Bianco FCEyN 2013 144

Distribuciones χ2, F y t no centrales

Def: Sean X1, · · · , Xν va. independientes tales que Xi ∼ N(ξi , 1). Luego:

U =ν∑

i=1X2i ∼ χ

′2ν,δ

donde el parametro de no centralidad es δ =

⎛⎜⎝ν∑

i=1ξ2i

⎞⎟⎠1/2

.

Se puede ver que si Yi ∼ N(0, 1) independientes entonces:

U = (Y1 + δ)2 +

ν∑

i=2Y 2i

U = (Y1 + δ)2 + χ2ν−1

Propiedades:

E(χ′2ν,δ) = ν + δ

Modelo Lineal A. M. Bianco FCEyN 2013 145

V ar (χ′2ν,δ) = 2ν + 4δ

2

Suma de χ2 no centrales independientes:

Si U1 ∼ χ′2ν1,δ1independiente de U2 ∼ χ

′2ν2,δ2, entonces

U1 + U2 ∼ χ′2ν1+ν2,(δ

21+δ

22)1/2

Distribucion F no central:

Def: Si U1 ∼ χ′2ν1,δ1independiente de U2 ∼ χ2ν2, tenemos que

U1/ν1U2/ν2

∼ F ′ν1,ν2,δ1es decir, F no central de ν1 y ν2 grados de libertad y parametro de no cen-

Modelo Lineal A. M. Bianco FCEyN 2013 146

tralidad δ1.

Distribucion t no central:

Def: Sean X ∼ N(δ, 1) independiente de U ∼ χ2ν, tenemos queX

√U/ν

∼ t ′ν,δ

es decir, t no central con ν y parametro de no centralidad δ.

Observacion: Notemos que t′ν,δ = F

′1,ν,δ

Potencia del test de F

Consideremos la base ortonormal de IRn:

α1, . . . ,αq,αq+1, . . . ,αr ,αr+1, . . . ,αn

Modelo Lineal A. M. Bianco FCEyN 2013 147

dondeVr−q : αq+1, . . . ,αr

Vr : α1, . . . ,αq,αq+1, . . . ,αrPor lo tanto,

y ∈ <n =⇒ y = n∑

j=1zjαj =⇒ α′iy = zi

y si definimos a T como la matriz que tiene filas α′i , entonces

z = Ty

Observemos que bajo el modelo Ω

zi independientes y zi ∼ N(ξi , σ2)donde

ξr+1 = ξr+2 = · · · = ξn = 0Bajo el modelo restringido ω, tenemos que

ξ1 = ξ2 = · · · = ξq = 0

Modelo Lineal A. M. Bianco FCEyN 2013 148

Usamos el estadıstico F :

‖η − ηω‖2qs2

=∑qi=1 z

2i

qs2

donde

s2 =

n∑

i=r+1z2i

n − rYa probamos que z1, · · · , zq y zr+1, · · · , zn son independientes y comoE(zi) = 0 si i ≥ r + 1 =⇒

n∑

i=r+1

⎛⎝ziσ

⎞⎠2

=(n − r )s2

σ2∼ χ2n−r

Sin embargo, si H0 es ciertaq∑

i=1

⎛⎝ziσ

⎞⎠2

∼ χ2qde lo contrario

ziσ∼ N(ξi

σ, 1)

Modelo Lineal A. M. Bianco FCEyN 2013 149

⇓

q∑

i=1

⎛⎝ziσ

⎞⎠2

∼ χ′2q,δ con δ2 =q∑

i=1

⎛⎜⎝ξiσ

⎞⎟⎠

2

Por lo tanto, si H0 no es cierta

F =‖η − ηω‖2

qs2∼ F ′q,n−r,δ

y la potencia del test sera:

P (F′q,n−r,δ ≥ Fq,n−r,α)

donde

δ =

√√√√√√q∑

i=1

⎛⎜⎝ξiσ

⎞⎟⎠

2

Modelo Lineal A. M. Bianco FCEyN 2013 150

¿Como se calcula δ en terminos de los parametros originales?

z = Ty =⇒ zi = α′iy =

n∑

j=1αi jyj =⇒ ξi = E(zi) = α

′iη

en consecuenciaξi = E(zi) =

n∑

j=1αi jηj

Tenemos las siguientes igualdades:

‖η − ηω‖2 =q∑

i=1z2i

σ2δ2 =q∑

i=1ξ2i

y reemplazando a las zi ’s obtenemos

‖η − ηω‖2 =q∑

i=1

⎛⎜⎝n∑

j=1αi jyj

⎞⎟⎠2

σ2δ2 =q∑

i=1

⎛⎜⎝n∑

j=1αi jηj

⎞⎟⎠2

Modelo Lineal A. M. Bianco FCEyN 2013 151

Con lo cual obtenemos la Regla 1: Bajo el modelo Ω

obtenemos σ2δ2 reemplazando en la suma de cuadrados ‖η − ηω‖2 cada Yipor su valor esperado.

Cuadrados Medios

En el denomirador del estadıstico F tenemos: s2 = ‖y−η‖2n−r y su esperanza es

σ2.

En el numerador del estadıstico F tenemos:‖η − ηω‖2

q=

∑qi=1 z

2i

qluego

E

⎛⎜⎜⎝‖η − ηω‖2

q

⎞⎟⎟⎠ = E

⎛⎜⎜⎝

∑qi=1 z

2i

q

⎞⎟⎟⎠

=1

q

q∑

i=1E(z2i )

Modelo Lineal A. M. Bianco FCEyN 2013 152

=1

q

q∑

i=1(σ2 + ξ2i )

= σ2 + q−1σ2δ2

Podemos calcular σ2δ2 con la Regla 1. Observemos que en realidad aquı noes necesaria la normalidad, solo alcanza con tener el modelo

Ω′ : E(Y) = Xβ Σ = σ2I

¿Como quedarıa en el caso de regresion lineal?

Ω : Yi = β0 + β1xi + εi εi ∼ N(0, σ2) independientes

ConsideremosH0 : β1 = 0 H1 : β1 6= 0

Modelo Lineal A. M. Bianco FCEyN 2013 153

Bajo ω = Ω∩H0 tenemos que Yi = β0+ εi , entonces el estimador de mınimoscuadrados sera ˆ

β0 = Y .

Para calcular la potencia necesitamos:

‖η − ηω‖2 =n∑

i=1(ˆβ0 +

ˆβ1xi − Y )2

Usando la Regla 1, reemplazamos por los valores esperados bajo Ω:

σ2δ2 =n∑

i=1

⎛⎜⎜⎜⎜⎜⎜⎜⎝β0 + β1xi −

n∑

i=1(β0 + β1xi)

n

⎞⎟⎟⎟⎟⎟⎟⎟⎠

2

=n∑

i=1(β0 + β1xi − β0 − β1x)2

=n∑

i=1β12 (xi − x)2

= β12 n∑

i=1(xi − x)2

Modelo Lineal A. M. Bianco FCEyN 2013 154

por lo tanto

δ2 =β12 n∑

i=1(xi − x)2

σ2

Analisis de la Varianza de 1 Factor (ANOVA 1)

En el Analisis de la Varianza de 1 Factor nos interesa comparar las medias de kpoblaciones . Supongamos que tenemos k poblaciones y llamamos β1, · · · , βka sus medias y que ademas cada poblacion se distribuye segun una normal ytodas tienen la misma varianza σ2.

Es decir, observamos

y11, y12, . . . , y1j . . . , y1n1 ∼ N(β1, σ2)

y21, y22, . . . , y2j . . . , y2n2 ∼ N(β2, σ2)

· · ·yk1, yk2, . . . , ykj . . . , yknk ∼ N(βk , σ

2)

Modelo Lineal A. M. Bianco FCEyN 2013 155

donde yi j es la j-esima observacion de la i-esima poblacion, todas independientes.En total se tienen n =

∑ki=1 ni observaciones.

Podemos escribir este modelo como.

yi j = βi + εi j i =, · · · , k j = 1, · · · , niεi j ∼ N(0, σ2) independientes

Deseamos testear:

H0 : β1 = · · · = βk H1 : existen i 6= j : βi 6= βj

Podrıamos escribir esto en forma matricial definiendo:

Modelo Lineal A. M. Bianco FCEyN 2013 156

Y =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

y11y12. . .

y1n1y21y22. . .

. . .

. . .

y2n2· · ·yk1yk2. . .

yknk

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

;X =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

1 0 0 ... 0

1 0 0 ... 0

. . . . .

1 0 0 ... 0

0 1 0 ... 0

0 1 0 ... 0

. . . . .

. . . . .

. . . . .

0 1 0 ... 0

. . . . .

0 0 0 ... 1

0 0 0 ... 1

. . . . .

0 0 0 ... 1

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

;β =

⎛⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎜⎝

β1β2...

...

...

βk

⎞⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎟⎠

donde rg(X) = k . En consecuencia en este modelo todas las funciones de laforma c′β son estimables.

Modelo Lineal A. M. Bianco FCEyN 2013 157

Ejemplo (ANOVA 1) En la siguiente tabla se muestran los porcentajes decontenido de acidos grasos no saturados activos (PAPFUA) presentes en 6margarinas dieteticas:

IMPERIAL PARKAY BLUE BONNET CHIFFON MAZOLA FLEISCHMANN’S

14.1 12.8 13.5 13.2 16.8 18.1

13.6 12.5 13.4 12.7 17.2 17.1

14.4 13.4 14.1 12.6 16.4 18.3