Act. 2 informatica123

-

Upload

1dmecatronica -

Category

Education

-

view

77 -

download

0

Transcript of Act. 2 informatica123

ÍNDICE

Ética como institución. Ética y derecho. Los términos opuestos a moral. Ética descriptiva. La responsabilidad en el ámbito de las relaciones ser humano-robot. Historia de la robótica. leyes de la robótica. ¿Pura ciencia ficción? Un ejemplo. ¿La ciencia-ficción nos llega a casa? Un dato.

ÉTICA COMO INSTITUCIÓN.

Nos dice que su finalidad es que exista relación con los deseos de las personas para que exista cooperación social para sobrevivir, que exista el bienestar con la sociedad.

ÉTICA Y DERECHO.

La diferencia entre estas dos es que en un determinado lugar el derecho es valido para sus ciudadanos y hace valer una pena fiscal para los agresores, en el derecho solo el juez puede decidir la sentencia.

LOS TÉRMINOS OPUESTOS A MORAL.

Los términos como inmoralidad, no moral, etc. Dependen de las creencias de la persona que lo pronuncia.

ÉTICA DESCRIPTIVA.

ética descriptiva limita a constatar el dato que de hecho existe y a describirlo detallada y minuciosamente.

El segundo significado nos dice que es un programa de investigación y se caracteriza por reducir la ética a los modos de proceder de la ciencia,

la responsabilidad en el ámbito de las relaciones ser humano-robot.

En esta parte del texto nos habla sobre la responsabilidad en la relación entre el hombre y las maquinas, nos menciona el caso de los robots. Si el robot realiza una mala acción, ¿Quién tendrá la culpa?, el robot o su creador, su creador o su programador.

Isaac Asimov publicó en 1950 su compendio de cuentos 'Yo, robot', en los que se recorría un futuro posible en que robots casi humanos plantearían nuevos.

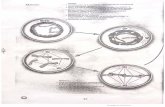

historia de la robótica.

leyes de la robótica de ASIMOV .

1º: Un robot no puede hacer daño a un ser humano o, por inacción, permitir que un ser humano sufra daño.

2º: Un robot debe obedecer las órdenes dadas por los seres humanos, excepto si estas órdenes entrasen en conflicto con la Primera Ley.

3º: Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la Primera o la Segunda Ley.

¿PURA CIENCIA FICCIÓN?

Desde luego, sí en los años 50 e incluso en parte ahora: aunque disponemos de robots para casi todas las actividades, lo cierto es que no es sencillo considerar "inteligente" a un tren de montaje automatizado de coches.

UN EJEMPLO

Por ejemplo, el robot-niñera (Nanny Robot) que, no es de extrañar, fue propuesto por otro autor de ciencia-ficción, Philip K. Dick en 1952, y que ya está comercializado en Corea del Sur, el país más 'robotizado' del planeta.

Precisamente, el Ministerio de Economía de Corea del Sur, según informaba BBC hace unos días, previendo que en 10 años los robots estarán en todas las casas y que previsiblemente tendrán más contacto con los humanos.

¿LA CIENCIA-FICCIÓN NOS LLEGA A CASA? Algo así parece. Convendría no olvidar que ya las

Naciones Unidas llevan unos años estudiando si en el futuro los desarrollos de la robótica y la inteligencia artificial.

UN DATO

El Gobierno de Corea del Sur prepara la publicación de un código ético para prevenir los abusos de humanos a robots y viceversa.